EU AI Act: что ждёт финансовый сектор в августе 2026

Дедлайн приближается

2 августа 2026 года — дата, которую финансовый сектор Европы обводит красным в календаре. В этот день вступают в силу основные положения EU AI Act (Регламента ЕС об искусственном интеллекте), касающиеся систем высокого риска. А большинство ИИ-систем в финансах попадают именно в эту категорию.

Какие финансовые ИИ-системы считаются высокорисковыми

Согласно Приложению III EU AI Act, к системам высокого риска относятся ИИ-системы, используемые для:

- Оценки кредитоспособности физических лиц

- Кредитного скоринга — определения условий кредита

- Ценообразования страховых продуктов на основе личных данных

- Оценки рисков при страховании жизни и здоровья

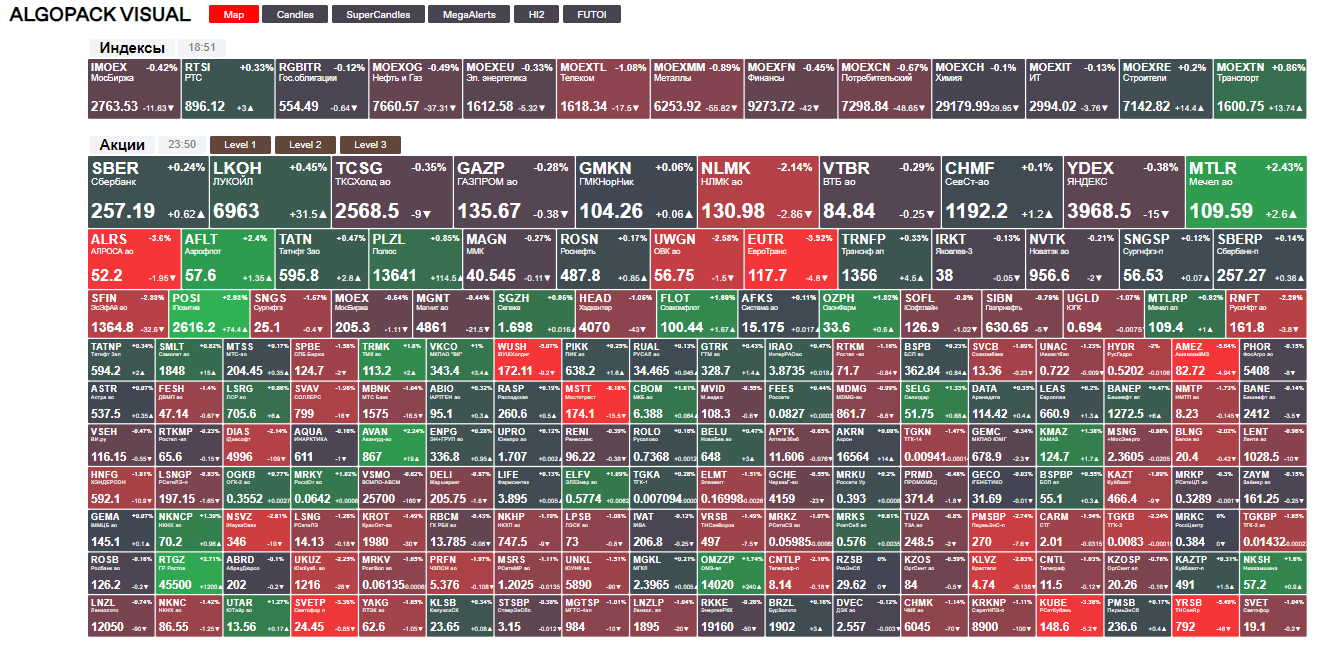

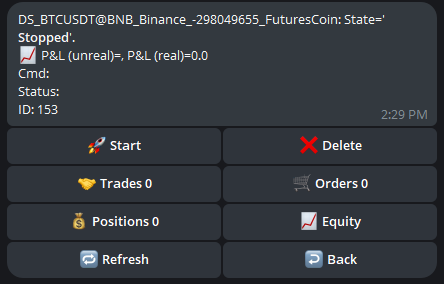

- Автоматической торговли — алгоритмические торговые системы могут подпадать под требования для финансового сектора, хотя прямое включение HFT в Приложение III обсуждается

- Антифрод-систем — автоматическое выявление мошенничества

Основные требования

1. Система управления рисками (Article 9)

Необходимо внедрить непрерывную систему оценки и управления рисками, включающую:

- Идентификацию и анализ известных и предсказуемых рисков

- Оценку рисков при использовании системы по назначению и при предсказуемом неправильном использовании

- Меры по минимизации рисков

- Тестирование системы

2. Качество данных (Article 10)

Обучающие, валидационные и тестовые датасеты должны:

- Быть релевантными, репрезентативными и по возможности свободными от ошибок

- Учитывать особенности географического, поведенческого и функционального контекста

- Содержать данные для выявления предвзятости (bias)

3. Техническая документация (Article 11)

Каждая система должна иметь подробную документацию:

- Описание системы и её предназначения

- Архитектура, алгоритмы, процесс обучения

- Метрики производительности и ограничения

- Меры кибербезопасности

4. Логирование (Article 12)

Системы должны автоматически вести логи:

- Каждого использования системы

- Принятых решений и их оснований

- Входных данных и результатов

5. Прозрачность (Article 13)

Пользователи должны понимать, как система работает:

- Понятная инструкция по использованию

- Информация о возможностях и ограничениях

- Уровень точности и известные ошибки

6. Человеческий контроль (Article 14)

Система должна обеспечивать возможность:

- Полного понимания возможностей и ограничений

- Мониторинга работы в реальном времени

- Переопределения или остановки системы человеком

Штрафы

| Нарушение | Штраф |

|---|---|

| Использование запрещённых ИИ-систем | До €35 млн или 7% мирового оборота |

| Несоблюдение требований для высокорисковых систем | До €15 млн или 3% оборота |

| Предоставление ложной информации | До €7.5 млн или 1.5% оборота |

Для сравнения: максимальные штрафы по GDPR — €20 млн или 4% оборота.

Кто должен готовиться

Банки и финтех

Любой банк, использующий ИИ для кредитного скоринга, AML-проверок или автоматизации решений, должен привести системы в соответствие.

Страховые компании

ИИ-модели для ценообразования и андеррайтинга требуют полной документации и аудита.

Инвестиционные фонды

Алгоритмические торговые системы, использующие ML-модели, подпадают под требования Article 9-14.

Брокеры

Если брокер предлагает ИИ-рекомендации клиентам — это система высокого риска.

Практические шаги

- Проведите инвентаризацию всех ИИ-систем в организации

- Классифицируйте каждую по уровню риска согласно EU AI Act

- Назначьте ответственных за compliance

- Начните документирование — это самая трудоёмкая часть

- Внедрите систему мониторинга и логирования

- Проведите аудит данных, используемых для обучения

До дедлайна осталось менее 5 месяцев. Если вы ещё не начали — самое время.

Обсуждение

Присоединяйтесь к обсуждению в нашем Telegram-чате!