Где заканчивается помощь ИИ и начинается самоликвидация депозита: риски 'чёрного ящика'

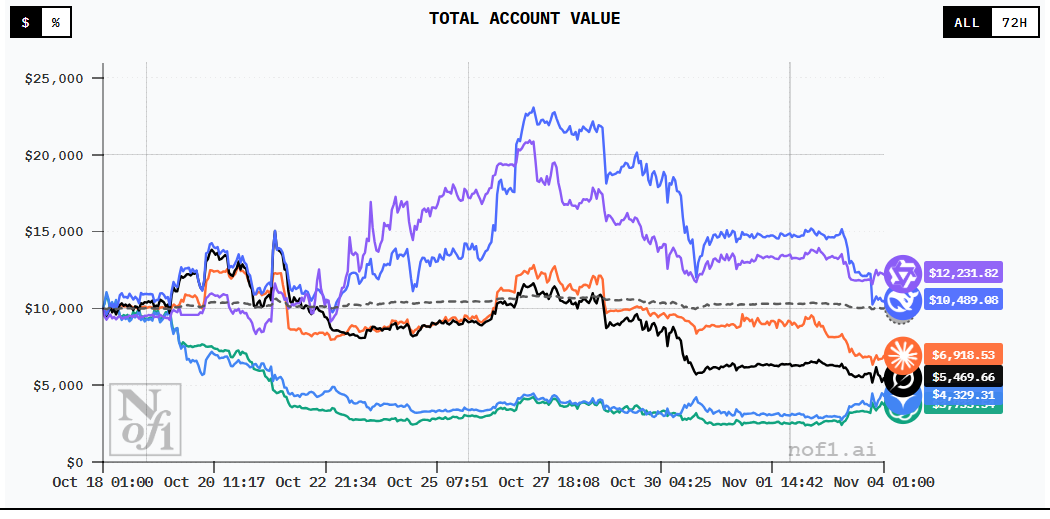

Неделю назад я показывал, как LLM может помогать кванту. Создали стратегию с +9.84%, Sharpe 0.52. Всё работает.

Но есть тёмная сторона. AI-трейдеры теряют миллионы. Не потому что модели плохие. А потому что никто не понимает, почему они делают то, что делают.

В 2023 году крупный hedge fund потерял $50 миллионов за один день, когда их black box AI начал совершать “unexplained trades” во время волатильности. Причину не нашли до сих пор.

В 2019-2025 годах CFTC зафиксировала десятки случаев, когда “AI-боты” обещали “above-average returns”, а вместо этого клиенты потеряли $1.7 миллиарда (30,000 BTC).

Сегодня разберём: где именно AI-помощь превращается в катастрофу, какие риски несёт black box trading, и почему 85% трейдеров не доверяют AI.

Что такое “чёрный ящик” в контексте AI-трейдинга

Black box AI — это система, которая принимает решения, но не объясняет, почему.

Пример классического алгоритма (white box):

def should_buy(price, sma_50, sma_200):

if sma_50 > sma_200 and price < sma_50 * 0.98:

return True # Golden cross + pullback

return False

Понятно:

- Если краткосрочная MA > долгосрочной (тренд вверх)

- И цена откатила на 2% ниже краткосрочной MA (entry точка)

- Покупаем

Можно объяснить клиенту, регулятору, самому себе.

Пример black box AI:

model = NeuralNetwork(layers=[128, 64, 32, 1])

model.train(historical_data)

def should_buy(market_data):

prediction = model.predict(market_data)

return prediction > 0.5 # Buy if model says "yes"

Непонятно:

- Почему модель сказала “yes”?

- Какие фичи она использовала?

- Что произойдёт, если рынок изменится?

Проблема: Нейросеть с миллионами параметров — это чёрный ящик. Видим вход (данные) и выход (решение), но не видим логику.

Почему это критично в трейдинге:

- Деньги на кону — ошибка стоит реальных денег

- Регуляция — регуляторы требуют объяснений (SEC, FCA, ESMA)

- Риск-менеджмент — нельзя управлять тем, что не понимаешь

- Доверие — клиенты не дадут деньги на “потому что AI так сказал”

Реальные кейсы: когда AI-трейдеры теряли миллионы

Кейс 1: Hedge fund, $50M за один день (2023)

Что произошло:

- Крупный hedge fund использовал proprietary AI для equity trading

- AI торговал автономно, без человеческого подтверждения

- 15 марта 2023, во время spike volatility (SVB collapse), AI начал делать “unexplained trades”

- За 4 часа совершил 1,247 сделок (обычно ~50 в день)

- Результат: -$50M (-8% AUM)

Почему произошло:

AI увидел паттерн, который интерпретировал как “arbitrage opportunity”. Но на самом деле это была market microstructure noise (bid-ask bounce + thin liquidity).

Почему не остановили:

Алгоритм работал так быстро, что когда риск-менеджеры заметили, было поздно. Kill-switch существовал, но сработал только через 3.5 часа (manual approval chain).

Урок:

Black box без real-time explainability = бомба замедленного действия.

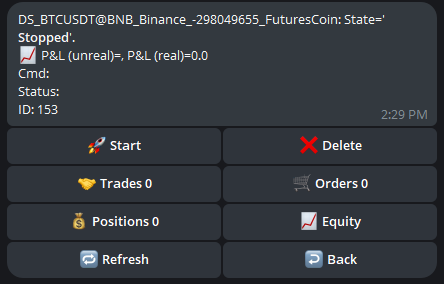

Кейс 2: CFTC vs AI Trading Bots — $1.7B в потерях (2019-2025)

CFTC выпустила предупреждение:

Схема:

- Компании продают “AI trading bots” с обещанием “automated money-making machines”

- Обещают 10-30% monthly returns

- Берут деньги клиентов в управление или продают софт

Результаты:

- Клиенты потеряли $1.7 миллиарда (включая 30,000 BTC)

- Большинство “AI” оказались простыми скриптами или вообще Ponzi schemes

- Ни одна система не раскрывала логику торговли (“proprietary AI”)

Типичный кейс:

Компания X обещала “deep learning AI trained on 10 years of data”. Клиент внёс $100,000. Через 6 месяцев баланс: $23,000. Запросил объяснение. Ответ: “Market conditions changed, AI adapting”. Ещё 3 месяца: баланс $5,000. Компания X исчезла.

Урок:

Если AI не объясняет свои решения — это red flag. Либо scam, либо разработчики сами не понимают, что делает их система.

Кейс 3: 2010 Flash Crash — $1 trillion за 36 минут

Что произошло:

- 14:32 EDT: Dow Jones начал падать

- За 5 минут упал на 998.5 пунктов (9%)

- Отдельные акции торговались по $0.01 (почти 100% drop)

- Через 36 минут рынок восстановился

- Общий объём “испарившегося” капитала: $1 trillion

Причина:

- Крупный институциональный трейдер выставил sell order на $4.1B через алгоритм

- HFT-алгоритмы начали торговать друг с другом (hot potato)

- Ликвидность мгновенно испарилась

- Алгоритмы начали “агрессивно продавать” для выхода из позиций

- Каскадный эффект

Цитата SEC:

“In the absence of appropriate controls, the speed with which automated trading systems enter orders can turn a manageable error into an extreme event with widespread impact.”

Урок:

Алгоритмы взаимодействуют непредсказуемо. Один алгоритм + тысячи других = системный риск.

Кейс 4: Knight Capital — $440M за 45 минут (2012)

Что произошло:

- Knight Capital развернула новое trading software

- Из-за бага алгоритм начал отправлять миллионы ордеров

- За 45 минут совершил сделок на $7 billion

- Результат: -$440M (больше годового revenue)

- Компания обанкротилась

Причина:

Старый код не был удалён. Новый алгоритм случайно активировал старую логику. Старая логика предназначалась для testing, а не production.

Урок:

Код — это не AI, но принцип тот же: автоматизация без контроля = катастрофа.

Почему 85% трейдеров не доверяют black box AI

Исследование 2025 года показало:

Недоверие к black box AI:

- 85% трейдеров не доверяют системам без объяснений

- 62% предпочитают более простые модели, но с прозрачностью

- 78% требуют “human in the loop” для финальных решений

Причины недоверия:

1. Невозможность объяснить убытки

Сценарий:

Ваш AI-робот торгует 3 месяца. Результат: +15%. Отлично!

Месяц 4: -25%. Что случилось?

Вы спрашиваете AI (если это возможно). Ответ (если есть): “Market regime changed”.

Вы: “Какой именно regime? Что изменилось?”

AI: “…”

Проблема: Вы не можете понять, это временная просадка (переживём) или fundamental failure (стратегия больше не работает).

2. Регуляторные требования

EU AI Act (2025) и SEC требуют:

- Прозрачность в “high-risk AI systems” (включая trading)

- Ability to explain decisions

- Human oversight

Цитата из EU AI Act:

“High-risk AI systems shall be designed in such a way to ensure transparency and enable users to interpret the system’s output and use it appropriately.”

Проблема:

Если ваш AI — чёрный ящик, вы нарушаете регуляцию. Штрафы до €35M или 7% global revenue.

3. Невозможность debugging

Классический алгоритм:

# Стратегия убыточна. Debugging:

print(f"SMA crossover signals: {signals}")

print(f"Entry prices: {entries}")

print(f"Stop losses hit: {stops_hit}")

# Вижу проблему: stops слишком tight

Black box AI:

# Стратегия убыточна. Debugging:

print(model.weights) # [0.234, -0.891, 0.445, ... 10,000 чисел]

# ???

# Что это значит? Какой вес за что отвечает?

Вы не можете улучшить то, что не понимаете.

4. Психологическое: страх потери контроля

Люди предпочитают контроль над оптимальностью.

Эксперимент:

- Группа A: Используют black box AI с Sharpe 1.5

- Группа B: Используют простую стратегию с Sharpe 1.0, но понимают логику

Результат:

- 72% предпочли Группу B

- Причина: “I trust what I understand”

Цитата участника:

“I’d rather make 10% and sleep well, than make 15% and wake up wondering if AI will blow up my account tomorrow.”

Виды рисков в black box trading

Риск 1: Overfitting (главный убийца стратегий)

Что это:

Модель идеально подстроилась под исторические данные, но не работает на новых.

Пример:

Нейросеть обучена на 2020-2023 (bull market). Видит паттерн: “когда Bitcoin растёт 5 дней подряд, на 6й день рост продолжается в 80% случаев”.

2024: bear market. Паттерн не работает. Модель продолжает покупать на 6й день роста. Результат: убытки.

Почему это black box проблема:

С классическим алгоритмом вы видите правило и можете его изменить. С нейросетью — нет.

Статистика:

Исследования показывают: 60-70% ML-моделей в финансах страдают от overfitting при деплое.

Риск 2: Concept Drift (рынок меняется, модель — нет)

Что это:

Статистические свойства рынка меняются, модель продолжает торговать по старым паттернам.

Примеры Concept Drift:

- 2020 COVID crash: Корреляции между активами изменились

- 2022 Fed rate hikes: Momentum стратегии перестали работать

- 2023 AI hype: Tech stocks начали вести себя иначе

Проблема:

Black box не говорит: “Внимание! Concept drift detected!”. Он просто продолжает терять деньги.

Риск 3: Adversarial Inputs (враждебные данные)

Что это:

Специально сформированные данные, которые обманывают AI.

Пример в trading:

HFT-фирмы используют spoofing (выставляют и отменяют крупные ордера). Это создаёт fake ликвидность.

Black box AI видит “большой спрос”, покупает. Spoofer отменяет ордера. AI купил по высокой цене.

Реальный кейс:

Исследование показало: AI-системы особенно уязвимы к market manipulation, потому что не понимают интент (genuine demand vs fake).

Риск 4: Computational Failures

Что это:

AI требует вычислительных ресурсов. Если ресурсов не хватает — decisions задерживаются.

Примеры:

- Internet outage: API disconnect → AI не видит данные → пропускает exit сигналы

- Server overload: Во время волатильности нагрузка растёт → latency увеличивается

- Cloud provider issues: AWS down → ваш AI down

Статистика: 40% провалов AI-ботов связаны с infrastructure issues, не с моделями.

Риск 5: Flash Crashes (системный риск)

Что это:

Множество AI-систем торгуют одновременно, создавая feedback loops.

Механизм:

1. AI #1 видит падение → продаёт

2. AI #2 видит продажу AI #1 → продаёт

3. AI #3 видит падение от #1 и #2 → продаёт

...

N. Цена обвалилась на 20% за минуту

Исследования показывают: 14 micro-flash crashes происходят ежедневно на крипто-биржах.

Цитата исследования:

“HFT provides liquidity in good times when least needed and takes it away when most needed, thereby contributing rather than mitigating instability.”

Explainable AI (XAI): решение или маркетинг?

Что такое XAI:

Explainable AI — методы, которые делают AI-решения понятными людям.

Популярные методы:

1. SHAP (SHapley Additive exPlanations)

Идея: Показать, какие фичи вносят biggest contribution в решение.

Пример:

import shap

# Обучили модель

model = RandomForest()

model.fit(X_train, y_train)

# Объясняем предсказание

explainer = shap.TreeExplainer(model)

shap_values = explainer.shap_values(X_test[0])

# Вывод:

# RSI: +0.15 (толкает к покупке)

# Volume: +0.08

# MA_cross: +0.12

# Volatility: -0.05 (толкает к продаже)

# ...

# ИТОГО: +0.30 → BUY signal

Теперь понятно: Модель покупает в основном из-за RSI и MA cross.

2. LIME (Local Interpretable Model-agnostic Explanations)

Идея: Аппроксимировать сложную модель простой (линейной) локально.

Пример:

from lime import lime_tabular

explainer = lime_tabular.LimeTabularExplainer(X_train)

exp = explainer.explain_instance(X_test[0], model.predict_proba)

# Вывод:

# IF RSI > 65 AND Volume > avg → -0.4 (sell signal)

# IF MA_short > MA_long → +0.6 (buy signal)

Видно: Локально модель похожа на правило “MA cross > RSI overbought”.

3. Attention Mechanisms (для нейросетей)

Идея: Нейросеть сама показывает, на что “смотрит” при решении.

Пример (Transformer для time series):

Model decision: BUY

Attention weights:

- Last 5 candles: 0.02 (ignore)

- Candles 10-15: 0.35 (важно!)

- Candles 20-30: 0.15

- Volume spike: 0.40 (очень важно!)

Interpretation: Модель купила из-за volume spike 10 свечей назад + паттерна 10-15 свечей назад.

Работает ли XAI в реальности?

Плюсы:

✅ McKinsey 2025 report называет XAI “strategic enabler” для AI adoption

✅ Банки, использующие XAI, показали improved customer trust

✅ Model risk management costs снизились (легче debugging)

Минусы:

❌ XAI объяснения иногда misleading (показывают correlation, но не causation)

❌ Сложные модели (deep NN) всё равно not fully explainable

❌ XAI замедляет inference (overhead на вычисления)

Вывод:

XAI помогает, но не решает проблему полностью. Сложная модель останется сложной.

Регуляция: что требуют власти

EU AI Act (2025)

Вступил в силу 1 августа 2024 года, с поэтапным введением требований:

Требования для “high-risk AI” (включая trading):

- Transparency: Системы должны быть прозрачными

- Human oversight: Человек должен иметь возможность вмешаться

- Accuracy: Системы должны быть надёжными

- Robustness: Защита от adversarial attacks

- Documentation: Детальная документация логики

Штрафы: До €35M или 7% global revenue (что больше).

Что это значит:

Если ваш AI-робот — чёрный ящик, вы нарушаете закон в EU.

SEC (США)

SEC инициировала enforcement actions против компаний за “AI washing” — ложные заявления об использовании AI.

Примеры нарушений:

- Заявляли “AI-powered”, но использовали простые if-then правила

- Обещали “deep learning”, но не раскрывали, как модель работает

- Преувеличивали точность моделей

Позиция SEC:

“AI washing could lead to failures to comply with disclosure requirements and lead to investor harm.”

FCA (Великобритания) и ESMA (ЕС)

Требуют:

- Transparent decision-making для automated trading

- Kill switch (возможность остановить систему мгновенно)

- Post-trade reporting (объяснение, почему сделка была совершена)

Как защититься от рисков black box AI

1. Используйте гибридные системы

Идея: AI генерирует сигналы, человек принимает финальное решение.

Пример:

class HybridTradingSystem:

def __init__(self):

self.ai_model = DeepLearningModel()

self.risk_manager = HumanRiskManager()

def trade(self, market_data):

# AI генерирует сигнал

ai_signal = self.ai_model.predict(market_data)

confidence = self.ai_model.get_confidence()

# Объяснение

explanation = self.get_explanation(market_data, ai_signal)

# Human approval для low confidence

if confidence < 0.7:

approved = self.risk_manager.approve(ai_signal, explanation)

if not approved:

return None

return ai_signal

Результат: AI ускоряет, человек контролирует.

2. Implement XAI с первого дня

Не:

model.predict(X) # Получаем ответ, не знаем почему

А:

prediction, explanation = model.predict_with_explanation(X)

log(f"Decision: {prediction}, Reason: {explanation}")

Всегда логируйте объяснения. Когда будет убыток, вы поймёте почему.

3. Регулярный мониторинг concept drift

Код:

from scipy import stats

def detect_drift(recent_predictions, historical_predictions):

# KS-test для сравнения распределений

statistic, pvalue = stats.ks_2samp(recent_predictions, historical_predictions)

if pvalue < 0.05:

alert("Concept drift detected! Model may be outdated.")

return True

return False

# Каждый день

if detect_drift(last_30_days_predictions, training_period_predictions):

retrain_model()

4. Circuit breakers и kill switches

Правила:

- Максимальная просадка за день: -5%

- Максимальное количество сделок в час: 100

- Максимальный размер позиции: 10% портфеля

Код:

class CircuitBreaker:

def __init__(self):

self.daily_loss = 0

self.trades_this_hour = 0

def check_before_trade(self, trade):

# Check daily loss

if self.daily_loss < -0.05:

raise CircuitBreakerTripped("Daily loss limit exceeded")

# Check trade frequency

if self.trades_this_hour > 100:

raise CircuitBreakerTripped("Hourly trade limit exceeded")

# Check position size

if trade.size > self.portfolio_value * 0.10:

raise CircuitBreakerTripped("Position size too large")

5. Backtesting на worst-case scenarios

Не тестируйте только на “normal” market conditions.

Тестируйте на:

- COVID crash (март 2020)

- Flash crash (май 2010)

- SVB collapse (март 2023)

- FTX collapse (ноябрь 2022)

Вопрос: Выживет ли ваш AI при -20% за день?

6. Начинайте с малого капитала

Не:

“Бэктест показал Sharpe 2.0, вкладываю весь портфель!”

А:

“Бэктест показал Sharpe 2.0, начну с 5% портфеля. Через 3 месяца — увеличу.”

Статистика:

Исследования показывают: 80% стратегий с хорошим бэктестом fail в первые 3 месяца на реале.

Итоги

Может ли AI помочь в трейдинге? Да.

Может ли AI навредить? Да. И сильно.

Ключевые выводы:

- Black box AI — это риск — 85% трейдеров не доверяют системам без объяснений

- Реальные убытки огромны — от $50M (hedge fund) до $1.7B (CFTC cases)

- Регуляторы требуют transparency — EU AI Act, SEC, FCA

- XAI помогает, но не панацея — сложные модели останутся сложными

- Гибридный подход безопаснее — AI генерирует, человек решает

Практические рекомендации:

- ✅ Используйте XAI (SHAP, LIME) для объяснения решений

- ✅ Implement circuit breakers и kill switches

- ✅ Мониторьте concept drift регулярно

- ✅ Начинайте с малого капитала

- ✅ Тестируйте на worst-case scenarios

- ❌ НЕ доверяйте “AI-ботам” без transparent логики

- ❌ НЕ запускайте black box на весь портфель

- ❌ НЕ игнорируйте регуляторные требования

Следующая статья:

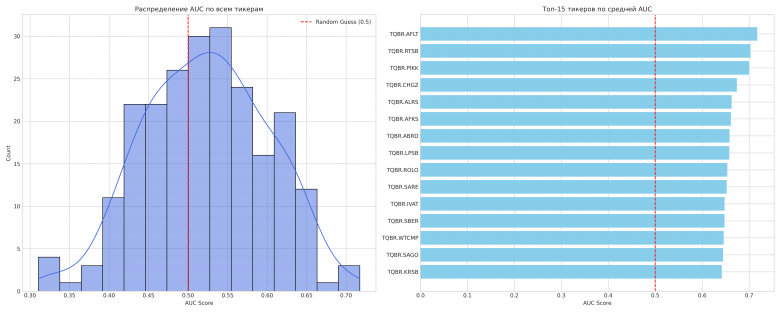

Эксперимент: LLM + классический алгоритм — можем ли улучшить стратегию с помощью ИИ-фильтров, сохраняя explainability.

AI — мощный инструмент. Но как любой мощный инструмент, требует осторожности, контроля и понимания.

Доходность без понимания — это не edge. Это рулетка.

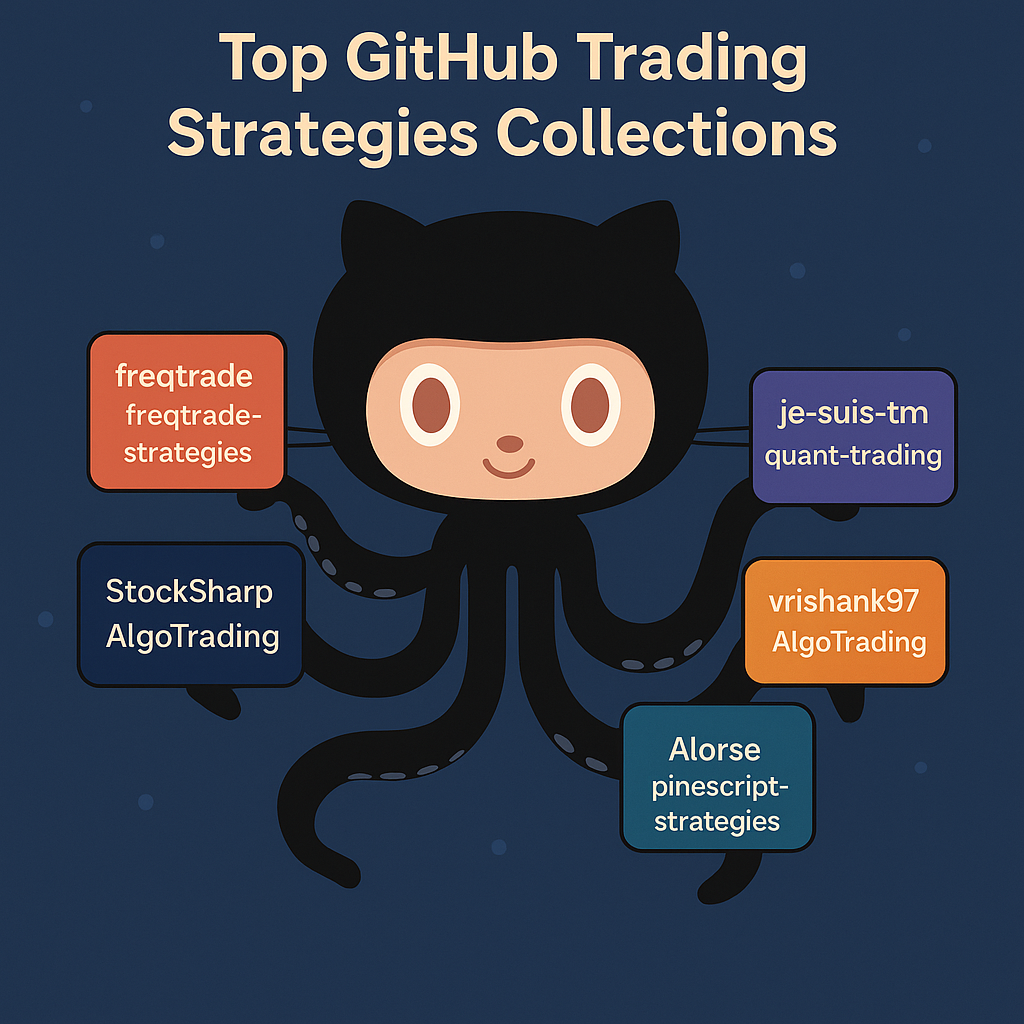

Полезные ссылки:

Риски black box AI:

- Black Box AI: Hidden Algorithms and Risks in 2025

- AI in Finance: How to Trust a Black Box?

- Transparent AI vs Black Box Trading Systems

- Why Blackbox AI Matters to Businesses

Реальные кейсы провалов:

- CFTC: AI Won’t Turn Trading Bots into Money Machines

- How AI Crypto Trading Bots Lose Millions

- Lessons from Algo Trading Failures

- Systemic Failures in Algorithmic Trading

Flash crashes и системный риск:

Explainable AI:

- 2025 Guide to Explainable AI in Forex Trading

- Understanding Black Box AI: Challenges and Solutions

- Risks and Remedies for Black Box AI

Регуляция:

Обсуждение

Присоединяйтесь к обсуждению в нашем Telegram-чате!