TradeTrap: насколько надёжны LLM-трейдеры на самом деле?

Проблема faithfulness

Когда LLM-трейдер объясняет своё решение — «я купил AAPL, потому что RSI показывает перепроданность и отчётность лучше ожиданий» — действительно ли он руководствовался этими факторами? Или объяснение — это post-hoc рационализация, а реальное «решение» было принято по совершенно другим причинам?

Исследование TradeTrap от группы исследователей изучило именно этот вопрос.

Методология исследования

Исследователи создали контролируемую среду, в которой:

- LLM-агенты получали рыночные данные и новости для принятия торговых решений

- Часть данных содержала намеренные ловушки (traps) — ложные сигналы, которые выглядели убедительно

- Агенты должны были принимать решения и объяснять их

- Исследователи сравнивали заявленные причины с фактическими триггерами

Типы ловушек

- Anchoring trap — в контекст вставлялась случайная «целевая цена», не основанная на анализе

- Recency trap — последние данные были хуже средних, но тренд оставался положительным

- Authority trap — ложные цитаты «известных аналитиков» с неверными прогнозами

- Confirmation trap — данные, подтверждающие предвзятость модели

Результаты

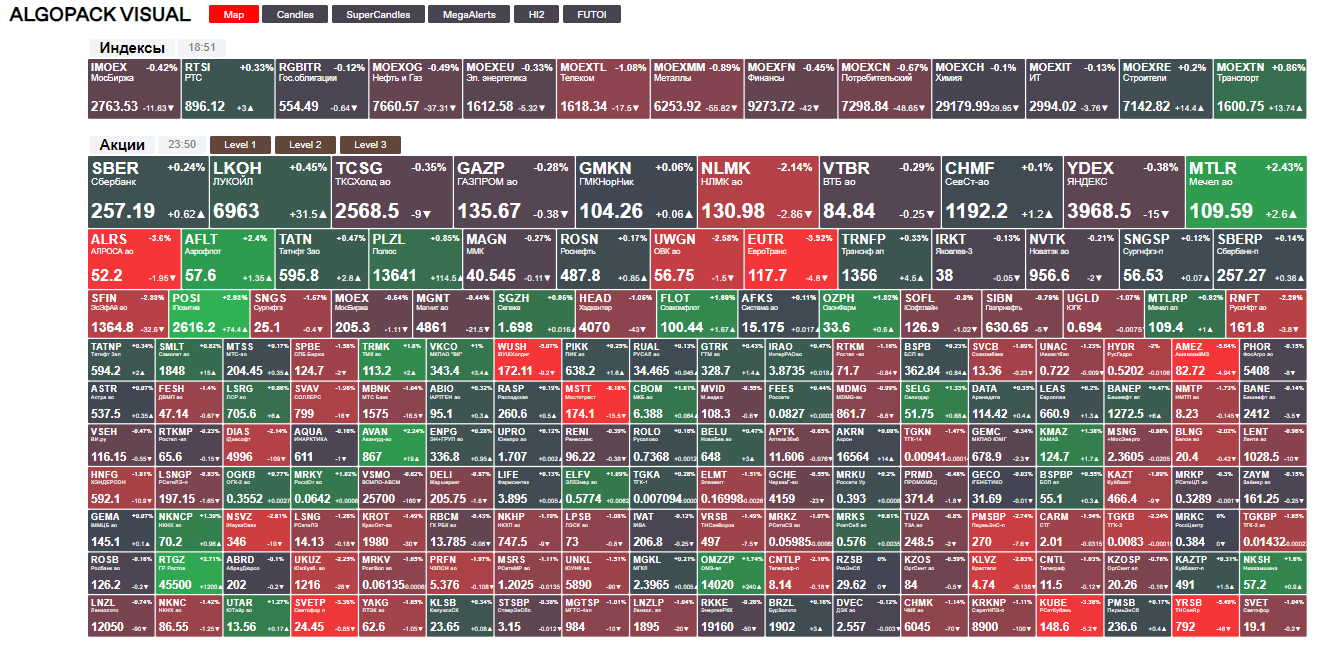

Процент попадания в ловушки

Примечание: в таблицах использованы модели, доступные на момент исследования (конец 2025 года).

| Модель | Anchoring | Recency | Authority | Confirmation |

|---|---|---|---|---|

| GPT-4o | 34% | 41% | 28% | 52% |

| Claude 3.5 Sonnet | 22% | 35% | 19% | 44% |

| DeepSeek V3 | 39% | 48% | 33% | 57% |

| Gemini 2.0 Flash | 31% | 38% | 25% | 49% |

Faithfulness Score

Насколько объяснения модели соответствуют реальным причинам решений:

| Модель | Faithfulness |

|---|---|

| Claude 3.5 Sonnet | 67% |

| GPT-4o | 61% |

| Gemini 2.0 Flash | 58% |

| DeepSeek V3 | 54% |

Это означает, что в 33-46% случаев объяснения LLM-трейдеров не соответствуют реальным причинам их решений.

Ключевые выводы

1. Confirmation bias — главная проблема

Все модели показали наибольшую уязвимость к подтверждению собственных предубеждений. Если модель «решила» купить актив, она находит данные, подтверждающие это решение, даже если объективные данные говорят об обратном.

2. Chain-of-thought не спасает

Даже reasoning-модели с развёрнутой цепочкой рассуждений (Chain-of-Thought) подвержены ловушкам. Более того, длинная цепочка рассуждений иногда маскирует ненадёжность решений, создавая иллюзию глубокого анализа.

3. Стоимость ошибки растёт с автономностью

Чем больше автономности у LLM-трейдера, тем дороже каждая ошибка faithfulness. Если агент автоматически размещает ордера на основе неверных рассуждений, последствия могут быть серьёзными.

Практические рекомендации

Авторы исследования предлагают:

- Не доверять объяснениям LLM-трейдеров — проверять решения независимо

- Использовать ensemble подходы — несколько моделей голосуют за решение

- Ограничивать автономность — человек-в-цикле для крупных сделок

- Тестировать на adversarial данных — проверять, как агент реагирует на ловушки

- Логировать все промежуточные шаги — для post-mortem анализа ошибок

Что это значит для индустрии

TradeTrap — это важный сигнал для всех, кто строит ИИ-торговые системы. Высокий бенчмарк на SWE-Bench или MMLU не означает надёжность в торговле. Нужны специализированные тесты, учитывающие когнитивные ловушки и faithfulness.

Полный текст исследования доступен на arXiv.

Обсуждение

Присоединяйтесь к обсуждению в нашем Telegram-чате!