开源LLM:为什么开放模型正在胜出

开放性正在胜出

在2023年,AI的未来似乎属于闭源模型:OpenAI、Anthropic和Google投入数十亿美元进行专有研发。但到了2026年,局面发生了根本性的变化——开源模型不仅追赶上来,在许多任务上甚至已经超越了闭源对手。

关键参与者

DeepSeek(中国)

DeepSeek V3和R1给行业带来了巨大震动:

- 质量可比GPT-5,但训练成本低10倍

- 完全开源权重(Apache 2.0)

- 创新的MoE(混合专家)架构

- API对研究人员免费开放

Meta Llama 4(美国)

Meta继续其开放策略:

- Llama 4 Scout——1090亿参数,同级别最优

- Llama 4 Maverick——4000亿+参数,GPT-5的竞争者

- 许可证允许商业使用

- 庞大的社区和微调模型生态系统

Qwen 3(阿里巴巴,中国)

阿里云积极发展Qwen系列:

- 对中文和其他亚洲语言的出色支持

- 模型参数从5亿到720亿

- 多模态版本(文本+图像+音频)

- Apache 2.0许可证

Mistral Large 3(法国)

欧洲领导者Mistral AI:

- Mistral Large 3——质量可与GPT-4o竞争

- 专注于欧洲语言和EU AI Act合规

- 允许商业使用的许可证

- 可在消费级硬件上部署的高效架构

为什么开源模型正在胜出

1. 算法效率比数据更重要

DeepSeek证明了智能算法可以弥补较少的算力。他们的模型训练仅花费560万美元——比GPT-5便宜数十倍。

2. 社区加速发展

开源模型受益于数千名研究人员和开发者的贡献:

- 针对特定任务进行微调

- 针对不同硬件进行优化

- 发现并修复问题

- 创建工具和库

3. 控制权和安全性

组织偏好开源模型,因为它们可以:

- 在自有服务器上运行——数据不会离开边界

- 审计模型——了解它如何做出决策

- 定制——适应自身需求

- 避免依赖单一供应商的定价策略

4. 监管压力

EU AI Act和其他监管框架要求AI系统具有透明度。使用开源模型更容易实现合规。

基准测试:开源 vs 闭源

| 基准测试 | 最佳开源 | 最佳闭源 | 差距 |

|---|---|---|---|

| MMLU | DeepSeek V3 (89.5%) | Claude Opus 4.6 (91.2%) | 1.7% |

| HumanEval | Llama 4 Maverick (92.1%) | Claude Sonnet 4.6 (96.2%) | 4.1% |

| MATH-500 | DeepSeek R1 (95.2%) | o3 (97.8%) | 2.6% |

| MT-Bench | Qwen 3 72B (9.1) | GPT-5 (9.4) | 0.3 |

差距每个季度都在缩小。预计到2026年底,开源模型可能完全追平闭源模型。

实用建议

面向量化交易者和交易系统开发者:

- 从开源模型开始——DeepSeek V3和Llama 4免费可用

- 使用微调——将模型适配到金融领域

- 本地推理——vLLM、llama.cpp、Ollama可以让你在本地运行模型

- 组合使用——批量任务用开源模型,关键任务用闭源模型

AI的未来是开放的。这对所有人来说都是好消息。

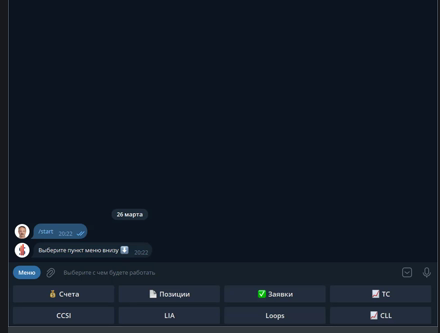

讨论

加入我们的讨论 Telegram 群组!