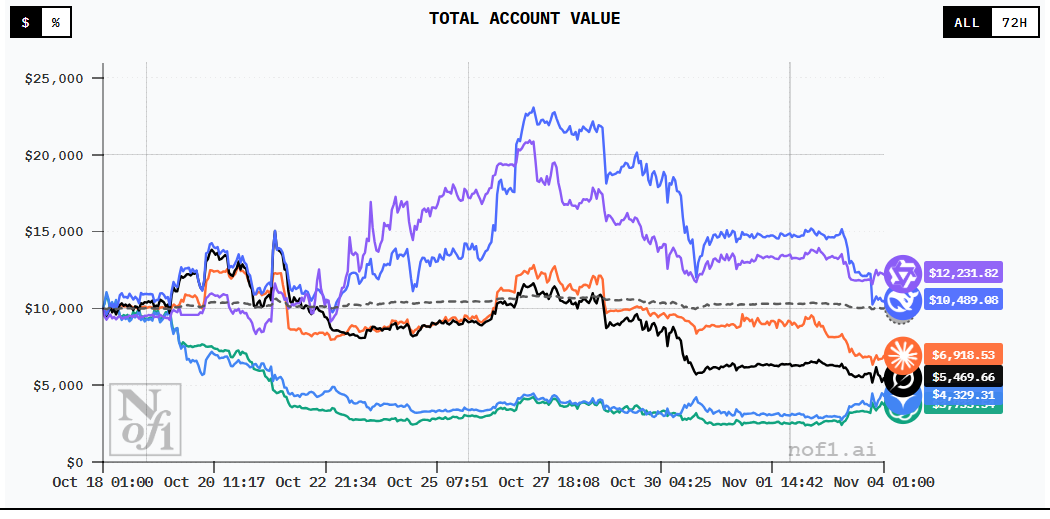

AI辅助的终点与账户自毁的起点:黑箱风险

一周前我展示了LLM如何帮助量化分析师。我们创建了一个+9.84%、夏普比率0.52的策略。一切正常。

但有黑暗的一面。AI交易者正在亏损数百万。不是因为模型不好。而是因为没有人理解它们为什么做出那些决策。

2023年,一家大型对冲基金在一天之内亏损了5000万美元,当时他们的黑箱AI在波动期间开始进行”无法解释的交易”。原因至今未找到。

2019至2025年间,CFTC记录了数十起案例,其中”AI机器人”承诺”超额回报”,但客户实际亏损了17亿美元(30,000 BTC)。

今天我们来分析:AI辅助究竟在哪里变成了灾难,黑箱交易带来哪些风险,以及为什么85%的交易者不信任AI。

AI交易中的”黑箱”是什么

黑箱AI是一个做出决策但不解释原因的系统。

经典算法示例(白箱):

def should_buy(price, sma_50, sma_200):

if sma_50 > sma_200 and price < sma_50 * 0.98:

return True # Golden cross + pullback

return False

清晰明了:

- 如果短期MA > 长期MA(上升趋势)

- 且价格回调至短期MA下方2%(入场点)

- 买入

可以向客户、监管机构和自己解释。

黑箱AI示例:

model = NeuralNetwork(layers=[128, 64, 32, 1])

model.train(historical_data)

def should_buy(market_data):

prediction = model.predict(market_data)

return prediction > 0.5 # Buy if model says "yes"

不清楚:

- 模型为什么说”是”?

- 它使用了哪些特征?

- 如果市场变化会怎样?

问题:拥有数百万参数的神经网络是一个黑箱。你能看到输入(数据)和输出(决策),但看不到逻辑。

为什么这在交易中至关重要:

- 真金白银 ——错误意味着真实的损失

- 监管要求 ——监管机构要求解释(SEC、FCA、ESMA)

- 风险管理 ——你无法管理不理解的东西

- 信任 ——客户不会因为”AI说的”就把钱交给你

真实案例:AI交易者亏损数百万

案例1:对冲基金,一天亏损5000万美元(2023)

故事:

发生了什么:

- 一家大型对冲基金使用专有AI进行股票交易

- AI完全自主交易,无需人工确认

- 2023年3月15日,在波动性飙升期间(SVB倒闭),AI开始进行”无法解释的交易”

- 4小时内完成了1,247笔交易(通常每天约50笔)

- 结果:-5000万美元(-8% AUM)

原因:

AI发现了一个它解释为”套利机会”的模式。但实际上这是市场微观结构噪音(买卖价差反弹 + 流动性不足)。

为什么没有被制止:

算法运行速度太快,当风控人员注意到时已经为时已晚。紧急停止开关存在,但在3.5小时后才触发(需要人工审批链)。

教训:

没有实时可解释性的黑箱 = 定时炸弹。

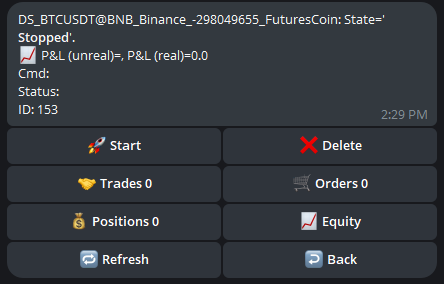

案例2:CFTC vs AI交易机器人——17亿美元损失(2019-2025)

套路:

- 公司销售”AI交易机器人”,承诺”自动赚钱机器”

- 承诺每月10-30%回报

- 接受客户资金管理或销售软件

结果:

- 客户损失17亿美元(包括30,000 BTC)

- 大多数”AI”实际上是简单脚本或彻底的庞氏骗局

- 没有一个系统公开其交易逻辑(”专有AI”)

典型案例:

X公司承诺”基于10年数据训练的深度学习AI”。客户投入100,000美元。6个月后余额:23,000美元。要求解释。回复:”市场条件变化,AI正在适应”。再过3个月:余额5,000美元。X公司消失了。

教训:

如果AI不解释其决策——这是危险信号。要么是骗局,要么开发者自己也不明白系统在做什么。

案例3:2010年闪崩——36分钟内蒸发1万亿美元

发生了什么:

- 美东时间14:32:道琼斯指数开始下跌

- 5分钟内下跌998.5点(9%)

- 个别股票以0.01美元交易(几乎下跌100%)

- 36分钟后市场恢复

- “蒸发”的总资本:1万亿美元

原因:

- 一位大型机构交易者通过算法下达了41亿美元的卖出订单

- HFT算法开始相互交易(烫手山芋)

- 流动性瞬间蒸发

- 算法开始”激进卖出”以退出仓位

- 级联效应

SEC引言:

“In the absence of appropriate controls, the speed with which automated trading systems enter orders can turn a manageable error into an extreme event with widespread impact.”

教训:

算法之间的交互不可预测。一个算法 + 数千个其他算法 = 系统性风险。

案例4:Knight Capital——45分钟亏损4.4亿美元(2012)

发生了什么:

- Knight Capital部署了新的交易软件

- 由于bug,算法开始发送数百万笔订单

- 45分钟内执行了70亿美元的交易

- 结果:-4.4亿美元(超过年收入)

- 公司破产

原因:

旧代码未被删除。新算法意外激活了旧逻辑。旧逻辑是为测试设计的,不是为生产环境。

教训:

代码不是AI,但原理相同:没有控制的自动化 = 灾难。

为什么85%的交易者不信任黑箱AI

2025年研究显示:

对黑箱AI的不信任:

- 85%的交易者不信任无法解释的系统

- 62%更喜欢较简单但透明的模型

- 78%要求最终决策中有”人在回路”

不信任的原因:

1. 无法解释亏损

场景:

你的AI机器人交易了3个月。结果:+15%。很好!

第4个月:-25%。发生了什么?

你问AI(如果可能的话)。回答(如果有的话):”市场机制变化。”

你:”具体哪个机制?变化了什么?”

AI:”…”

问题:你无法判断这是暂时性回撤(可以扛过去)还是根本性失败(策略不再有效)。

2. 监管要求

EU AI Act (2025)和SEC要求:

- “高风险AI系统”(包括交易)的透明度

- 解释决策的能力

- 人工监督

EU AI Act引言:

“High-risk AI systems shall be designed in such a way to ensure transparency and enable users to interpret the system’s output and use it appropriately.”

问题:

如果你的AI是黑箱,你就违反了法规。罚款最高可达3500万欧元或全球收入的7%。

3. 无法调试

经典算法:

# 策略在亏损。调试:

print(f"SMA crossover signals: {signals}")

print(f"Entry prices: {entries}")

print(f"Stop losses hit: {stops_hit}")

# 我看到问题了:止损设置太紧

黑箱AI:

# 策略在亏损。调试:

print(model.weights) # [0.234, -0.891, 0.445, ... 10,000个数字]

# ???

# 这意味着什么?哪个权重负责什么?

你无法改进你不理解的东西。

4. 心理因素:失去控制的恐惧

研究表明:

人们更偏好控制感而非最优性。

实验:

- A组:使用夏普比率1.5的黑箱AI

- B组:使用夏普比率1.0的简单策略,但理解其逻辑

结果:

- 72%选择了B组

- 原因:”I trust what I understand”

参与者引言:

“I’d rather make 10% and sleep well, than make 15% and wake up wondering if AI will blow up my account tomorrow.”

黑箱交易的风险类型

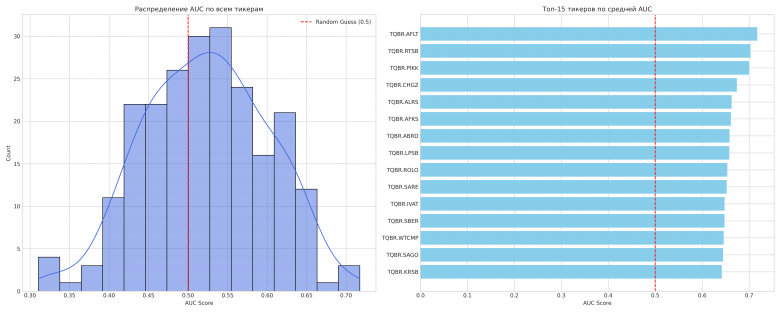

风险1:过拟合(策略的头号杀手)

定义:

模型完美拟合了历史数据,但在新数据上不起作用。

示例:

一个在2020-2023年(牛市)训练的神经网络。它发现一个模式:”当比特币连续上涨5天时,第6天80%的情况下继续上涨”。

2024年:熊市。该模式失效。模型继续在第6天买入。结果:亏损。

为什么这是黑箱问题:

使用经典算法,你可以看到规则并修改它。使用神经网络——你做不到。

统计数据:

研究表明:60-70%的金融ML模型在部署时存在过拟合问题。

风险2:概念漂移(市场在变,模型不变)

定义:

市场的统计特性发生变化,模型继续按旧模式交易。

概念漂移的例子:

- 2020年COVID崩盘:资产之间的相关性改变

- 2022年美联储加息:动量策略失效

- 2023年AI热潮:科技股开始表现不同

问题:

黑箱不会说:”注意!检测到概念漂移!”它只是继续亏钱。

风险3:对抗性输入

定义:

专门设计来欺骗AI的数据。

交易中的示例:

HFT公司使用欺骗性报价(下达然后取消大额订单)。这创造了虚假流动性。

黑箱AI看到”大量需求”并买入。欺骗者取消订单。AI以高价买入。

真实案例:

研究表明:AI系统特别容易受到市场操纵,因为它们不理解意图(真实需求 vs 虚假需求)。

风险4:计算故障

定义:

AI需要计算资源。如果资源不足——决策延迟。

示例:

- 网络中断:API断开 → AI看不到数据 → 错过退出信号

- 服务器过载:波动期间负载增加 → 延迟增大

- 云服务商问题:AWS宕机 → 你的AI宕机

统计数据:40%的AI机器人故障与基础设施问题有关,而非模型本身。

风险5:闪崩(系统性风险)

定义:

多个AI系统同时交易,产生反馈循环。

机制:

1. AI #1 看到下跌 → 卖出

2. AI #2 看到 AI #1 的卖出 → 卖出

3. AI #3 看到 #1 和 #2 导致的下跌 → 卖出

...

N. 价格在一分钟内暴跌20%

研究表明:加密货币交易所每天发生14次微型闪崩。

研究引言:

“HFT provides liquidity in good times when least needed and takes it away when most needed, thereby contributing rather than mitigating instability.”

可解释AI(XAI):解决方案还是营销?

什么是XAI:

可解释AI ——使AI决策对人类可理解的方法。

流行方法:

1. SHAP (SHapley Additive exPlanations)

思路:展示哪些特征对决策贡献最大。

示例:

import shap

# 训练好的模型

model = RandomForest()

model.fit(X_train, y_train)

# 解释预测

explainer = shap.TreeExplainer(model)

shap_values = explainer.shap_values(X_test[0])

# 输出:

# RSI: +0.15 (推向买入)

# Volume: +0.08

# MA_cross: +0.12

# Volatility: -0.05 (推向卖出)

# ...

# 总计: +0.30 → BUY signal

现在清楚了:模型主要因为RSI和MA交叉而买入。

2. LIME (Local Interpretable Model-agnostic Explanations)

思路:在局部用简单(线性)模型近似复杂模型。

示例:

from lime import lime_tabular

explainer = lime_tabular.LimeTabularExplainer(X_train)

exp = explainer.explain_instance(X_test[0], model.predict_proba)

# 输出:

# IF RSI > 65 AND Volume > avg → -0.4 (sell signal)

# IF MA_short > MA_long → +0.6 (buy signal)

可以看到:在局部,模型类似于规则”MA交叉 > RSI超买”。

3. 注意力机制(用于神经网络)

思路:神经网络自身展示做决策时”关注”了什么。

示例(时间序列Transformer):

Model decision: BUY

Attention weights:

- Last 5 candles: 0.02 (忽略)

- Candles 10-15: 0.35 (重要!)

- Candles 20-30: 0.15

- Volume spike: 0.40 (非常重要!)

解读:模型买入是因为10根K线前的成交量飙升 + 10-15根K线前的模式。

XAI在现实中有效吗?

优点:

-

McKinsey 2025报告称XAI为AI采用的”战略推动者”

-

使用XAI的银行显示客户信任度提高

-

模型风险管理成本降低(更容易调试)

缺点:

-

XAI解释有时具有误导性(显示相关性而非因果性)

-

复杂模型(深度神经网络)仍然无法完全解释

-

XAI减慢推理速度(计算开销)

结论:

XAI有帮助,但不能完全解决问题。复杂模型仍然是复杂的。

监管:当局要求什么

EU AI Act (2025)

“高风险AI”(包括交易)的要求:

- 透明度:系统必须透明

- 人工监督:人类必须能够干预

- 准确性:系统必须可靠

- 鲁棒性:防御对抗性攻击

- 文档:详细的逻辑文档

罚款:最高3500万欧元或全球收入的7%(取较高者)。

这意味着什么:

如果你的AI机器人是黑箱,你在欧盟就违法了。

SEC(美国)

SEC对公司发起执法行动,打击“AI洗白” ——关于使用AI的虚假声明。

违规示例:

- 声称”AI驱动”但使用简单的if-then规则

- 承诺”深度学习”但不披露模型工作方式

- 夸大模型准确性

SEC立场:

“AI washing could lead to failures to comply with disclosure requirements and lead to investor harm.”

FCA(英国)和ESMA(欧盟)

要求:

- 自动化交易的透明决策

- 紧急停止开关(立即停止系统的能力)

- 交易后报告(解释为什么执行了交易)

如何防范黑箱AI风险

1. 使用混合系统

思路:AI生成信号,人类做最终决策。

示例:

class HybridTradingSystem:

def __init__(self):

self.ai_model = DeepLearningModel()

self.risk_manager = HumanRiskManager()

def trade(self, market_data):

# AI生成信号

ai_signal = self.ai_model.predict(market_data)

confidence = self.ai_model.get_confidence()

# 解释

explanation = self.get_explanation(market_data, ai_signal)

# 低置信度时需要人工审批

if confidence < 0.7:

approved = self.risk_manager.approve(ai_signal, explanation)

if not approved:

return None

return ai_signal

结果:AI加速,人类控制。

2. 从第一天就实施XAI

不要这样做:

model.predict(X) # 得到答案,不知道原因

要这样做:

prediction, explanation = model.predict_with_explanation(X)

log(f"Decision: {prediction}, Reason: {explanation}")

始终记录解释。当出现亏损时,你会知道原因。

3. 定期监控概念漂移

代码:

from scipy import stats

def detect_drift(recent_predictions, historical_predictions):

# KS检验比较分布

statistic, pvalue = stats.ks_2samp(recent_predictions, historical_predictions)

if pvalue < 0.05:

alert("Concept drift detected! Model may be outdated.")

return True

return False

# 每天执行

if detect_drift(last_30_days_predictions, training_period_predictions):

retrain_model()

4. 熔断机制和紧急停止开关

规则:

- 每日最大回撤:-5%

- 每小时最大交易次数:100

- 最大仓位大小:投资组合的10%

代码:

class CircuitBreaker:

def __init__(self):

self.daily_loss = 0

self.trades_this_hour = 0

def check_before_trade(self, trade):

# 检查每日亏损

if self.daily_loss < -0.05:

raise CircuitBreakerTripped("Daily loss limit exceeded")

# 检查交易频率

if self.trades_this_hour > 100:

raise CircuitBreakerTripped("Hourly trade limit exceeded")

# 检查仓位大小

if trade.size > self.portfolio_value * 0.10:

raise CircuitBreakerTripped("Position size too large")

5. 在最坏场景下回测

不要只在”正常”市场条件下测试。

在以下场景测试:

- COVID崩盘(2020年3月)

- 闪崩(2010年5月)

- SVB倒闭(2023年3月)

- FTX倒闭(2022年11月)

问题:你的AI能在一天-20%的情况下生存吗?

6. 从小资金开始

不要这样做:

“回测显示夏普比率2.0,全仓投入!”

要这样做:

“回测显示夏普比率2.0,先用5%的资金。3个月后再增加。”

统计数据:

研究表明:80%回测表现良好的策略在实盘前3个月内失败。

总结

AI能帮助交易吗?能。

AI会造成损害吗?会。而且可能很严重。

关键要点:

- 黑箱AI是风险 ——85%的交易者不信任无解释的系统

- 真实损失巨大 ——从5000万美元(对冲基金)到17亿美元(CFTC案例)

- 监管机构要求透明度 ——EU AI Act、SEC、FCA

- XAI有帮助但非万能 ——复杂模型仍然复杂

- 混合方法更安全 ——AI生成,人类决策

实用建议:

- 使用XAI(SHAP、LIME)解释决策

- 实施熔断机制和紧急停止开关

- 定期监控概念漂移

- 从小资金开始

- 在最坏场景下测试

- 不要信任没有透明逻辑的”AI机器人”

- 不要将黑箱部署到整个投资组合

- 不要忽视监管要求

下一篇文章:

实验:LLM + 经典算法 ——我们能否用AI过滤器改善策略,同时保持可解释性?

AI是强大的工具。但和任何强大的工具一样,它需要谨慎、控制和理解。

没有理解的收益不是优势。那是赌博。

有用链接:

黑箱AI风险:

- Black Box AI: Hidden Algorithms and Risks in 2025

- AI in Finance: How to Trust a Black Box?

- Transparent AI vs Black Box Trading Systems

- Why Blackbox AI Matters to Businesses

真实失败案例:

- CFTC: AI Won’t Turn Trading Bots into Money Machines

- How AI Crypto Trading Bots Lose Millions

- Lessons from Algo Trading Failures

- Systemic Failures in Algorithmic Trading

闪崩和系统性风险:

可解释AI:

- 2025 Guide to Explainable AI in Forex Trading

- Understanding Black Box AI: Challenges and Solutions

- Risks and Remedies for Black Box AI

监管:

讨论

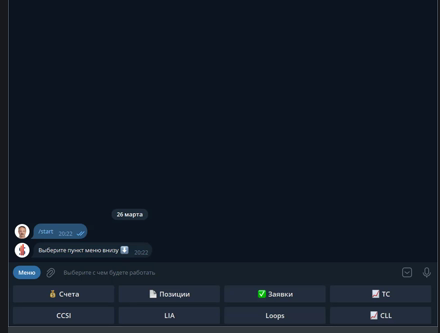

加入我们的讨论 Telegram 群组!