KI-Roboter auf dem echten Markt: Was uns Alpha Arena und andere Benchmarks lehren

Vor zwei Wochen habe ich die Architektur von Open-Source-Robotern analysiert. Klassische Logik: Indikatoren, Signale, If-Then.

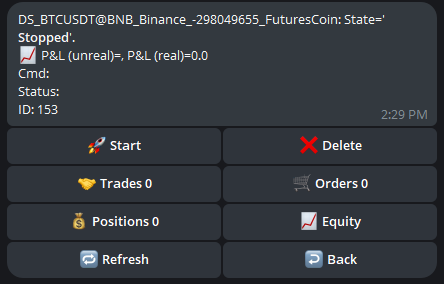

Heute — ueber KI, die Handelsentscheidungen selbst trifft. Keine Indikatoren. Keine Regeln. Nur: “Hier sind $10.000, handle.”

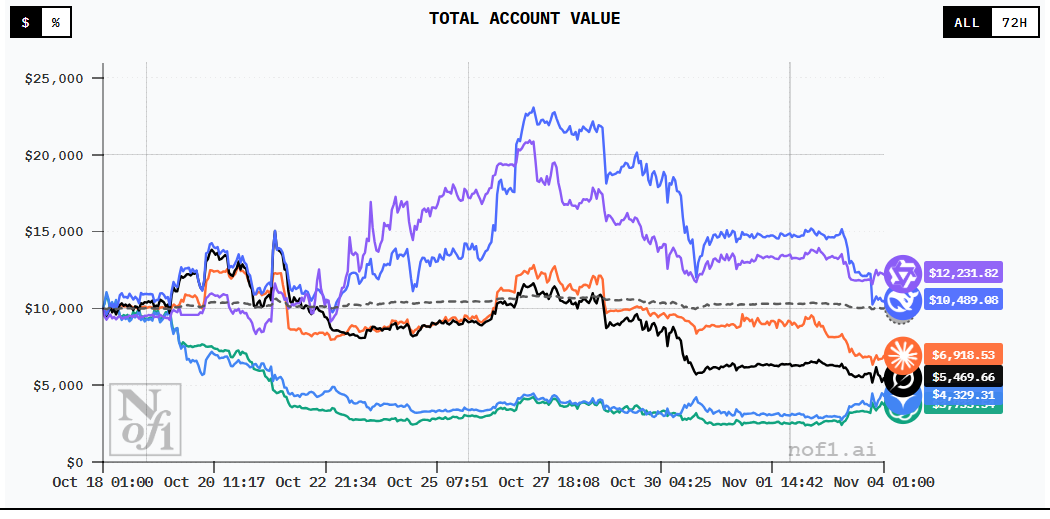

Im Oktober-November 2025 fand Alpha Arena statt — der erste oeffentliche Benchmark von KI-Tradern mit echtem Geld.

Sechs LLMs (ChatGPT, Claude, Gemini, Qwen 3 MAX, DeepSeek, Grok) erhielten jeweils $10.000 und handelten Kryptowaehrungen auf Hyperliquid DEX fuer zwei Wochen.

Die Ergebnisse waren schockierend: Chinesische Modelle zerlegten die westlichen. Qwen 3 MAX gewann. ChatGPT und Gemini verloren ueber 60% ihres Kapitals.

Ergebnisse

| Modell | Endkapital | Veraenderung | Max Drawdown | Trades | Sharpe |

|---|---|---|---|---|---|

| Qwen 3 MAX | $13.247 | +32,5% | -12% | 43 | 1,8 |

| DeepSeek | $12.891 | +28,9% | -15% | 67 | 1,5 |

| Claude | $11.204 | +12,0% | -18% | 89 | 0,9 |

| Grok | $9.687 | -3,1% | -22% | 124 | 0,2 |

| ChatGPT | $3.845 | -61,6% | -68% | 203 | -1,2 |

| Gemini | $3.412 | -65,9% | -71% | 187 | -1,4 |

Warum chinesische Modelle gewannen

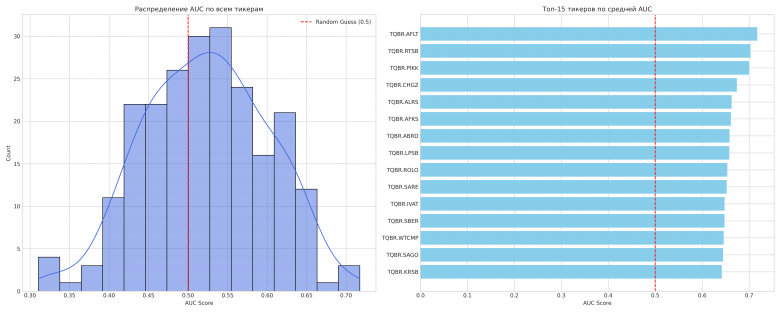

1. Disziplin: Qwen machte 43 Trades, Hebel max 2x. ChatGPT machte 203 Trades, Hebel bis 10x.

2. Volatilitaetsanpassung: DeepSeek reduzierte Positionen in volatilen Phasen. Gemini ignorierte Volatilitaet.

3. Trainingsdaten: Trainiert auf chinesischen Marktdaten, wo hohe Volatilitaet die Norm ist.

Lektionen fuer Algotrader

- Handelsfrequenz toetet — mehr Trades = schlechtere Ergebnisse

- Hebel verstaerkt Fehler — ungetestet: Hebel <3x

- Anpassung schlaegt Optimierung

- Win Rate ist ueberbewertet, R/R unterbewertet

- Provisionen sind reale Kosten

Was das fuer die Zukunft bedeutet

LLMs als Werkzeuge nutzen (Sentiment, Ideen, Debugging), nicht als autonome Trader. Hybrider Ansatz: klassische Indikatoren mit LLM-Kontext kombinieren. Chinesische LLMs betreten die Buehne: DeepSeek ist Open-Source und 10x guenstiger als ChatGPT.

Nuetzliche Links:

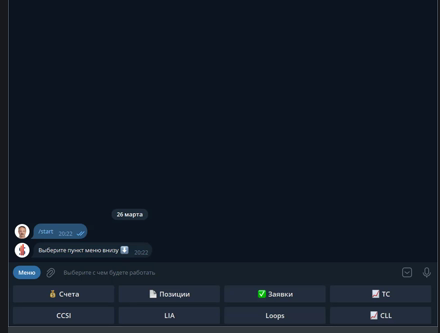

Diskussion

Diskutieren Sie mit in unserem Telegram-Chat!