EU AI Act: Was den Finanzsektor im August 2026 erwartet

Die Frist rückt näher

2. August 2026 — das Datum, das der europäische Finanzsektor rot im Kalender markiert hat. An diesem Tag treten die wichtigsten Bestimmungen des EU AI Act (EU-Verordnung über künstliche Intelligenz) für Hochrisikosysteme in Kraft. Und die meisten KI-Systeme im Finanzwesen fallen genau in diese Kategorie.

Welche Finanz-KI-Systeme als hochriskant gelten

Gemäß Anhang III des EU AI Act zählen zu den Hochrisiko-KI-Systemen solche, die eingesetzt werden für:

- Kreditwürdigkeitsprüfung von natürlichen Personen

- Kredit-Scoring — Festlegung von Kreditbedingungen

- Preisgestaltung von Versicherungsprodukten auf Basis persönlicher Daten

- Risikobewertung bei Lebens- und Krankenversicherungen

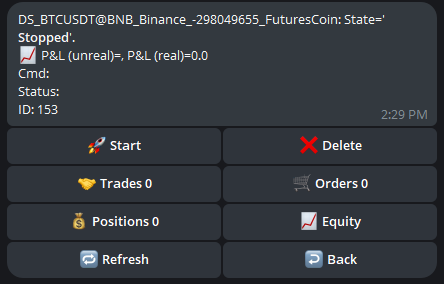

- Automatisierten Handel — algorithmische Handelssysteme können unter die Anforderungen des Finanzsektors fallen, obwohl die direkte Aufnahme von HFT in Anhang III noch diskutiert wird

- Anti-Betrugs-Systeme — automatische Betrugserkennung

Wesentliche Anforderungen

1. Risikomanagementsystem (Artikel 9)

Ein kontinuierliches Risikobewertungs- und Managementsystem muss implementiert werden, das umfasst:

- Identifikation und Analyse bekannter und vorhersehbarer Risiken

- Risikobewertung bei bestimmungsgemäßer Verwendung und vorhersehbarer Fehlanwendung

- Maßnahmen zur Risikominderung

- Systemtests

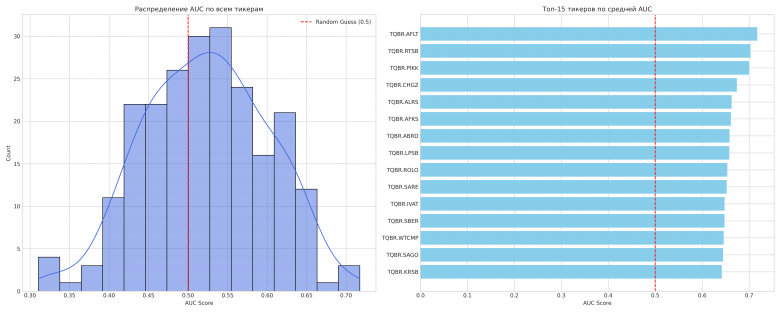

2. Datenqualität (Artikel 10)

Trainings-, Validierungs- und Testdatensätze müssen:

- Relevant, repräsentativ und möglichst fehlerfrei sein

- Die Besonderheiten des geografischen, verhaltensbezogenen und funktionalen Kontexts berücksichtigen

- Daten zur Erkennung von Verzerrungen (Bias) enthalten

3. Technische Dokumentation (Artikel 11)

Jedes System muss eine ausführliche Dokumentation aufweisen:

- Systembeschreibung und Verwendungszweck

- Architektur, Algorithmen und Trainingsprozess

- Leistungskennzahlen und Einschränkungen

- Cybersicherheitsmaßnahmen

4. Protokollierung (Artikel 12)

Systeme müssen automatisch protokollieren:

- Jede Nutzung des Systems

- Getroffene Entscheidungen und deren Begründung

- Eingabedaten und Ergebnisse

5. Transparenz (Artikel 13)

Nutzer müssen verstehen, wie das System funktioniert:

- Verständliche Bedienungsanleitung

- Informationen über Fähigkeiten und Einschränkungen

- Genauigkeitsniveau und bekannte Fehler

6. Menschliche Aufsicht (Artikel 14)

Das System muss die Möglichkeit bieten für:

- Vollständiges Verständnis der Fähigkeiten und Einschränkungen

- Echtzeitüberwachung des Betriebs

- Übersteuern oder Abschalten des Systems durch einen Menschen

Strafen

| Verstoß | Strafe |

|---|---|

| Einsatz verbotener KI-Systeme | Bis zu 35 Mio. Euro oder 7 % des weltweiten Umsatzes |

| Nichteinhaltung der Anforderungen für Hochrisikosysteme | Bis zu 15 Mio. Euro oder 3 % des Umsatzes |

| Bereitstellung falscher Informationen | Bis zu 7,5 Mio. Euro oder 1,5 % des Umsatzes |

Zum Vergleich: Die maximalen DSGVO-Strafen betragen 20 Mio. Euro oder 4 % des Umsatzes.

Wer sich vorbereiten muss

Banken und Fintech

Jede Bank, die KI für Kredit-Scoring, AML-Prüfungen oder automatisierte Entscheidungsfindung einsetzt, muss ihre Systeme in Einklang bringen.

Versicherungsunternehmen

KI-Modelle für Preisgestaltung und Underwriting erfordern eine vollständige Dokumentation und Prüfung.

Investmentfonds

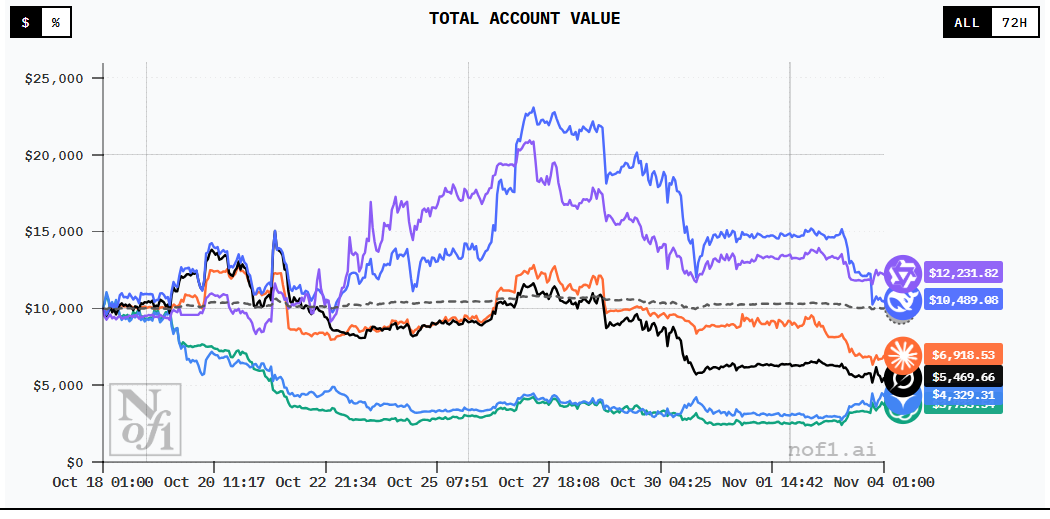

Algorithmische Handelssysteme, die ML-Modelle verwenden, unterliegen den Anforderungen der Artikel 9-14.

Broker

Wenn ein Broker seinen Kunden KI-Empfehlungen anbietet, handelt es sich um ein Hochrisikosystem.

Praktische Schritte

- Führen Sie eine Bestandsaufnahme aller KI-Systeme in Ihrer Organisation durch

- Klassifizieren Sie jedes System nach Risikoniveau gemäß dem EU AI Act

- Ernennen Sie Compliance-Verantwortliche

- Beginnen Sie mit der Dokumentation — das ist der arbeitsintensivste Teil

- Implementieren Sie ein Monitoring- und Protokollierungssystem

- Prüfen Sie die für das Training verwendeten Daten

Bis zur Frist verbleiben weniger als 5 Monate. Wenn Sie noch nicht begonnen haben — jetzt ist es an der Zeit.

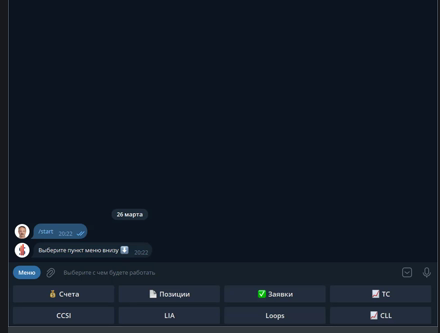

Diskussion

Diskutieren Sie mit in unserem Telegram-Chat!