Open-Source-LLMs: Warum offene Modelle gewinnen

Offenheit gewinnt

Noch 2023 schien die Zukunft der KI den geschlossenen Modellen zu gehören: OpenAI, Anthropic und Google investierten Milliarden in proprietäre Entwicklungen. Doch 2026 hat sich das Bild grundlegend verändert – offene Modelle haben nicht nur aufgeholt, sondern in einer Reihe von Aufgaben ihre geschlossenen Pendants übertroffen.

Schlüsselakteure

DeepSeek (China)

DeepSeek V3 und R1 waren ein echter Schock für die Branche:

- Qualität vergleichbar mit GPT-5 bei 10-fach niedrigeren Trainingskosten

- Vollständig offene Gewichte (Apache 2.0)

- Innovative MoE-Architektur (Mixture of Experts)

- API kostenlos für Forscher verfügbar

Meta Llama 4 (USA)

Meta setzt seine Offenheitsstrategie fort:

- Llama 4 Scout – 109 Milliarden Parameter, die Beste ihrer Klasse

- Llama 4 Maverick – 400+ Milliarden Parameter, GPT-5-Konkurrent

- Lizenz erlaubt kommerzielle Nutzung

- Riesige Community und Fine-Tune-Modell-Ökosystem

Qwen 3 (Alibaba, China)

Alibaba Cloud entwickelt aktiv die Qwen-Familie:

- Hervorragende Unterstützung für Chinesisch und andere asiatische Sprachen

- Modelle von 0,5B bis 72B Parametern

- Multimodale Versionen (Text + Bilder + Audio)

- Apache-2.0-Lizenz

Mistral Large 3 (Frankreich)

Der europäische Marktführer Mistral AI:

- Mistral Large 3 – Qualitätskonkurrent zu GPT-4o

- Fokus auf europäische Sprachen und EU-AI-Act-Konformität

- Lizenz mit kommerzieller Nutzung

- Effiziente Architektur für den Einsatz auf Consumer-Hardware

Warum offene Modelle gewinnen

1. Algorithmische Effizienz ist wichtiger als Daten

DeepSeek hat bewiesen, dass intelligente Algorithmen weniger Rechenleistung ausgleichen können. Ihr Modell wurde für 5,6 Millionen Dollar trainiert – zehnmal günstiger als GPT-5.

2. Die Community beschleunigt die Entwicklung

Ein offenes Modell profitiert von Beiträgen tausender Forscher und Entwickler:

- Fine-Tuning für spezifische Aufgaben

- Optimierung für verschiedene Hardware

- Entdeckung und Behebung von Problemen

- Erstellung von Tools und Bibliotheken

3. Kontrolle und Sicherheit

Organisationen bevorzugen offene Modelle, weil sie:

- Sie auf eigenen Servern betreiben können – Daten verlassen den Perimeter nicht

- Das Modell auditieren können – wissen, wie es Entscheidungen trifft

- Anpassen können – auf eigene Bedürfnisse zuschneiden

- Nicht abhängig von der Preispolitik eines einzelnen Anbieters sind

4. Regulatorischer Druck

Der EU AI Act und andere Regulierungsrahmen verlangen Transparenz bei KI-Systemen. Mit einem offenen Modell ist Compliance einfacher zu gewährleisten.

Benchmarks: Offen vs. Geschlossen

| Benchmark | Bestes Offenes | Bestes Geschlossenes | Abstand |

|---|---|---|---|

| MMLU | DeepSeek V3 (89,5 %) | Claude Opus 4.6 (91,2 %) | 1,7 % |

| HumanEval | Llama 4 Maverick (92,1 %) | Claude Sonnet 4.6 (96,2 %) | 4,1 % |

| MATH-500 | DeepSeek R1 (95,2 %) | o3 (97,8 %) | 2,6 % |

| MT-Bench | Qwen 3 72B (9,1) | GPT-5 (9,4) | 0,3 |

Der Abstand verringert sich jedes Quartal. Prognosen zufolge könnten offene Modelle bis Ende 2026 vollständig gleichziehen.

Praktische Empfehlungen

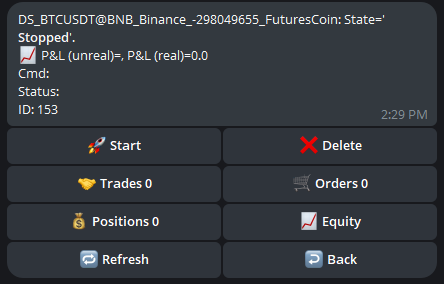

Für Algo-Trader und Entwickler von Handelssystemen:

- Beginnen Sie mit offenen Modellen – DeepSeek V3 und Llama 4 sind kostenlos

- Nutzen Sie Fine-Tuning – passen Sie das Modell an die Finanzdomäne an

- Lokale Inferenz – vLLM, llama.cpp, Ollama ermöglichen das lokale Ausführen von Modellen

- Kombinieren Sie – nutzen Sie offene Modelle für Massenaufgaben, geschlossene für geschäftskritische Entscheidungen

Die Zukunft der KI ist offen. Und das sind gute Nachrichten für alle.

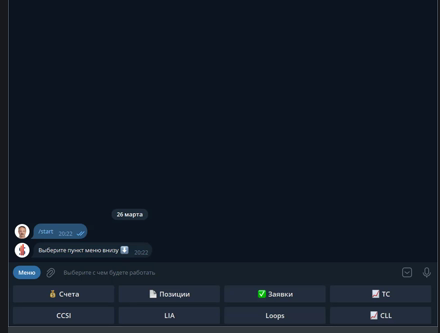

Diskussion

Diskutieren Sie mit in unserem Telegram-Chat!