Wo die KI-Hilfe endet und die Selbstvernichtung des Depots beginnt: Black-Box-Risiken

Vor einer Woche habe ich gezeigt, wie ein LLM einem Quant helfen kann. Wir haben eine Strategie mit +9,84 %, Sharpe 0,52 erstellt. Alles funktioniert.

Aber es gibt eine dunkle Seite. KI-Trader verlieren Millionen. Nicht weil die Modelle schlecht sind. Sondern weil niemand versteht, warum sie tun, was sie tun.

2023 verlor ein großer Hedgefonds 50 Millionen Dollar an einem einzigen Tag, als seine Black-Box-KI während der Volatilität begann, „unexplained trades” durchzuführen. Die Ursache wurde bis heute nicht gefunden.

Zwischen 2019 und 2025 dokumentierte die CFTC Dutzende von Fällen, in denen „KI-Bots” „above-average returns” versprachen, Kunden aber 1,7 Milliarden Dollar verloren (30.000 BTC).

Heute untersuchen wir: wo genau KI-Unterstützung zur Katastrophe wird, welche Risiken Black-Box-Trading birgt und warum 85 % der Trader der KI nicht vertrauen.

Was ist eine „Black Box” im KI-Trading

Black Box KI ist ein System, das Entscheidungen trifft, aber nicht erklärt, warum.

Beispiel klassischer Algorithmus (White Box):

def should_buy(price, sma_50, sma_200):

if sma_50 > sma_200 and price < sma_50 * 0.98:

return True # Golden cross + pullback

return False

Verständlich:

- Wenn der kurzfristige MA > langfristiger (Aufwärtstrend)

- Und der Preis 2 % unter den kurzfristigen MA zurückgefallen ist (Einstiegspunkt)

- Kaufen

Kann dem Kunden, dem Regulierer und sich selbst erklärt werden.

Beispiel Black Box KI:

model = NeuralNetwork(layers=[128, 64, 32, 1])

model.train(historical_data)

def should_buy(market_data):

prediction = model.predict(market_data)

return prediction > 0.5 # Buy if model says "yes"

Unklar:

- Warum hat das Modell „Ja” gesagt?

- Welche Features hat es verwendet?

- Was passiert, wenn sich der Markt ändert?

Das Problem: Ein neuronales Netz mit Millionen von Parametern ist eine Black Box. Man sieht den Input (Daten) und Output (Entscheidung), aber nicht die Logik.

Warum das im Trading kritisch ist:

- Geld steht auf dem Spiel — Fehler kosten echtes Geld

- Regulierung — Regulierer verlangen Erklärungen (SEC, FCA, ESMA)

- Risikomanagement — man kann nicht managen, was man nicht versteht

- Vertrauen — Kunden geben kein Geld auf Basis von „weil die KI es gesagt hat”

Reale Fälle: Als KI-Trader Millionen verloren

Fall 1: Hedgefonds, 50 Mio. $ an einem Tag (2023)

Was geschah:

- Ein großer Hedgefonds nutzte proprietäre KI für den Aktienhandel

- Die KI handelte autonom, ohne menschliche Bestätigung

- Am 15. März 2023 begann die KI während eines Volatilitätsspikes (SVB-Kollaps) „unexplained trades” zu machen

- In 4 Stunden tätigte sie 1.247 Trades (normalerweise ~50 pro Tag)

- Ergebnis: -50 Mio. $ (-8 % AUM)

Warum es passierte:

Die KI erkannte ein Muster, das sie als „Arbitrage-Gelegenheit” interpretierte. In Wirklichkeit war es Markt-Mikrostruktur-Rauschen (Bid-Ask-Bounce + geringe Liquidität).

Warum es nicht gestoppt wurde:

Der Algorithmus arbeitete so schnell, dass es zu spät war, als die Risikomanager es bemerkten. Ein Kill-Switch existierte, wurde aber erst nach 3,5 Stunden ausgelöst (manuelle Genehmigungskette).

Lektion:

Eine Black Box ohne Echtzeit-Erklärbarkeit = eine tickende Zeitbombe.

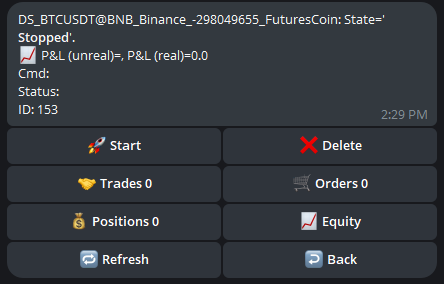

Fall 2: CFTC vs KI-Trading-Bots — 1,7 Mrd. $ Verluste (2019-2025)

Die CFTC gab eine Warnung heraus:

Das Schema:

- Unternehmen verkaufen „KI-Trading-Bots” und versprechen „automated money-making machines”

- Sie versprechen 10-30 % monatliche Rendite

- Sie nehmen Kundengelder in Verwaltung oder verkaufen Software

Ergebnisse:

- Kunden verloren 1,7 Milliarden Dollar (einschließlich 30.000 BTC)

- Die meisten „KIs” waren einfache Skripte oder Ponzi-Systeme

- Kein System legte seine Handelslogik offen („proprietäre KI”)

Typischer Fall:

Unternehmen X versprach „Deep-Learning-KI, trainiert auf 10 Jahren Daten”. Ein Kunde zahlte 100.000 $ ein. Nach 6 Monaten, Kontostand: 23.000 $. Er bat um eine Erklärung. Antwort: „Market conditions changed, AI adapting”. Noch 3 Monate: Kontostand 5.000 $. Unternehmen X verschwand.

Lektion:

Wenn die KI ihre Entscheidungen nicht erklärt — das ist ein Warnsignal. Entweder ein Betrug, oder die Entwickler verstehen selbst nicht, was ihr System tut.

Fall 3: Flash Crash 2010 — 1 Billion $ in 36 Minuten

Was geschah:

- 14:32 EDT: Der Dow Jones begann zu fallen

- In 5 Minuten fiel er um 998,5 Punkte (9 %)

- Einzelne Aktien wurden zu 0,01 $ gehandelt (fast 100 % Rückgang)

- Innerhalb von 36 Minuten erholte sich der Markt

- Gesamtes „verdampftes” Kapital: 1 Billion Dollar

Die Ursache:

- Ein großer institutioneller Händler platzierte eine Verkaufsorder über 4,1 Mrd. $ über einen Algorithmus

- HFT-Algorithmen begannen, untereinander zu handeln (hot potato)

- Die Liquidität verdampfte sofort

- Algorithmen begannen, „aggressiv zu verkaufen”, um Positionen zu schließen

- Kaskadeneffekt

SEC-Zitat:

“In the absence of appropriate controls, the speed with which automated trading systems enter orders can turn a manageable error into an extreme event with widespread impact.”

Lektion:

Algorithmen interagieren unvorhersehbar. Ein Algorithmus + Tausende andere = systemisches Risiko.

Fall 4: Knight Capital — 440 Mio. $ in 45 Minuten (2012)

Was geschah:

- Knight Capital setzte neue Trading-Software ein

- Aufgrund eines Bugs begann der Algorithmus, Millionen von Orders zu senden

- In 45 Minuten führte er Trades im Wert von 7 Milliarden Dollar aus

- Ergebnis: -440 Mio. $ (mehr als der Jahresumsatz)

- Das Unternehmen ging bankrott

Die Ursache:

Alter Code wurde nicht entfernt. Der neue Algorithmus aktivierte versehentlich die alte Logik. Die alte Logik war fürs Testing gedacht, nicht für Production.

Lektion:

Code ist keine KI, aber das Prinzip ist dasselbe: Automatisierung ohne Kontrolle = Katastrophe.

Warum 85 % der Trader Black-Box-KI nicht vertrauen

Eine Studie von 2025 zeigte:

Misstrauen gegenüber Black-Box-KI:

- 85 % der Trader vertrauen Systemen ohne Erklärungen nicht

- 62 % bevorzugen einfachere Modelle mit Transparenz

- 78 % verlangen „Human in the Loop” für finale Entscheidungen

Gründe für das Misstrauen:

1. Unmöglichkeit, Verluste zu erklären

Szenario:

Ihr KI-Roboter handelt 3 Monate. Ergebnis: +15 %. Hervorragend!

Monat 4: -25 %. Was ist passiert?

Sie fragen die KI (falls möglich). Antwort (falls vorhanden): „Market regime changed.”

Sie: „Welches Regime genau? Was hat sich geändert?”

KI: „…”

Das Problem: Sie können nicht feststellen, ob dies ein vorübergehender Drawdown ist (durchhalten) oder ein fundamentales Versagen (die Strategie funktioniert nicht mehr).

2. Regulatorische Anforderungen

EU AI Act (2025) und die SEC verlangen:

- Transparenz bei „Hochrisiko-KI-Systemen” (einschließlich Trading)

- Fähigkeit, Entscheidungen zu erklären

- Menschliche Aufsicht

Zitat aus dem EU AI Act:

“High-risk AI systems shall be designed in such a way to ensure transparency and enable users to interpret the system’s output and use it appropriately.”

Das Problem:

Wenn Ihre KI eine Black Box ist, verstoßen Sie gegen Vorschriften. Strafen bis zu 35 Mio. Euro oder 7 % des weltweiten Umsatzes.

3. Unmöglichkeit des Debuggings

Klassischer Algorithmus:

# Strategie verliert Geld. Debugging:

print(f"SMA crossover signals: {signals}")

print(f"Entry prices: {entries}")

print(f"Stop losses hit: {stops_hit}")

# Ich sehe das Problem: Stops sind zu eng

Black Box KI:

# Strategie verliert Geld. Debugging:

print(model.weights) # [0.234, -0.891, 0.445, ... 10.000 Zahlen]

# ???

# Was bedeutet das? Welches Gewicht ist wofür verantwortlich?

Man kann nicht verbessern, was man nicht versteht.

4. Psychologie: Angst vor Kontrollverlust

Menschen bevorzugen Kontrolle gegenüber Optimalität.

Experiment:

- Gruppe A: Nutzt Black-Box-KI mit Sharpe 1,5

- Gruppe B: Nutzt eine einfache Strategie mit Sharpe 1,0, versteht aber die Logik

Ergebnis:

- 72 % bevorzugten Gruppe B

- Grund: „I trust what I understand”

Teilnehmer-Zitat:

“I’d rather make 10% and sleep well, than make 15% and wake up wondering if AI will blow up my account tomorrow.”

Arten von Risiken im Black-Box-Trading

Risiko 1: Overfitting (der Strategie-Killer Nr. 1)

Was es ist:

Das Modell hat sich perfekt an historische Daten angepasst, funktioniert aber bei neuen Daten nicht.

Beispiel:

Ein neuronales Netz, trainiert auf 2020-2023 (Bullenmarkt). Es sieht ein Muster: „Wenn Bitcoin 5 Tage in Folge steigt, setzt sich der Anstieg am 6. Tag in 80 % der Fälle fort.”

2024: Bärenmarkt. Das Muster funktioniert nicht. Das Modell kauft weiter am 6. Tag des Anstiegs. Ergebnis: Verluste.

Warum das ein Black-Box-Problem ist:

Mit einem klassischen Algorithmus können Sie die Regel sehen und ändern. Mit einem neuronalen Netz — nicht.

Statistik:

Forschung zeigt: 60-70 % der ML-Modelle im Finanzbereich leiden bei der Bereitstellung unter Overfitting.

Risiko 2: Concept Drift (der Markt ändert sich, das Modell nicht)

Was es ist:

Die statistischen Eigenschaften des Marktes ändern sich; das Modell handelt weiter nach alten Mustern.

Beispiele für Concept Drift:

- COVID-Crash 2020: Korrelationen zwischen Assets änderten sich

- Fed-Zinserhöhungen 2022: Momentum-Strategien funktionierten nicht mehr

- KI-Hype 2023: Tech-Aktien begannen, sich anders zu verhalten

Das Problem:

Eine Black Box sagt nicht: „Achtung! Concept Drift erkannt!” Sie verliert einfach weiter Geld.

Risiko 3: Adversarial Inputs (feindliche Daten)

Was es ist:

Speziell gestaltete Daten, die die KI täuschen sollen.

Beispiel im Trading:

HFT-Firmen nutzen Spoofing (Platzieren und Stornieren großer Orders). Das erzeugt falsche Liquidität.

Die Black-Box-KI sieht „hohe Nachfrage” und kauft. Der Spoofer storniert die Orders. Die KI hat zu einem hohen Preis gekauft.

Realer Fall:

Forschung zeigte: KI-Systeme sind besonders anfällig für Marktmanipulation, weil sie die Absicht nicht verstehen (echte Nachfrage vs. vorgetäuschte).

Risiko 4: Berechnungsausfälle

Was es ist:

KI benötigt Rechenressourcen. Wenn die Ressourcen nicht ausreichen — verzögern sich Entscheidungen.

Beispiele:

- Internet-Ausfall: API-Trennung → KI sieht keine Daten → verpasst Exit-Signale

- Server-Überlastung: Bei Volatilität steigt die Last → Latenz nimmt zu

- Cloud-Provider-Probleme: AWS ausgefallen → Ihre KI ist ausgefallen

Statistik: 40 % der KI-Bot-Ausfälle hängen mit Infrastrukturproblemen zusammen, nicht mit Modellen.

Risiko 5: Flash Crashes (systemisches Risiko)

Was es ist:

Mehrere KI-Systeme handeln gleichzeitig und erzeugen Rückkopplungsschleifen.

Mechanismus:

1. KI #1 sieht einen Rückgang → verkauft

2. KI #2 sieht den Verkauf von KI #1 → verkauft

3. KI #3 sieht den Rückgang von #1 und #2 → verkauft

...

N. Preis brach in einer Minute um 20 % ein

Forschung zeigt: 14 Micro-Flash-Crashes geschehen täglich an Kryptobörsen.

Forschungszitat:

“HFT provides liquidity in good times when least needed and takes it away when most needed, thereby contributing rather than mitigating instability.”

Explainable AI (XAI): Lösung oder Marketing?

Was XAI ist:

Explainable AI — Methoden, die KI-Entscheidungen für Menschen verständlich machen.

Beliebte Methoden:

1. SHAP (SHapley Additive exPlanations)

Idee: Zeigen, welche Features den größten Beitrag zur Entscheidung leisten.

Beispiel:

import shap

# Trainiertes Modell

model = RandomForest()

model.fit(X_train, y_train)

# Vorhersage erklären

explainer = shap.TreeExplainer(model)

shap_values = explainer.shap_values(X_test[0])

# Ausgabe:

# RSI: +0.15 (drängt zum Kauf)

# Volume: +0.08

# MA_cross: +0.12

# Volatility: -0.05 (drängt zum Verkauf)

# ...

# GESAMT: +0.30 → BUY signal

Jetzt ist es klar: Das Modell kauft hauptsächlich wegen RSI und MA-Cross.

2. LIME (Local Interpretable Model-agnostic Explanations)

Idee: Das komplexe Modell lokal mit einem einfachen (linearen) approximieren.

Beispiel:

from lime import lime_tabular

explainer = lime_tabular.LimeTabularExplainer(X_train)

exp = explainer.explain_instance(X_test[0], model.predict_proba)

# Ausgabe:

# IF RSI > 65 AND Volume > avg → -0.4 (sell signal)

# IF MA_short > MA_long → +0.6 (buy signal)

Man sieht: Lokal ähnelt das Modell der Regel „MA-Cross > RSI überkauft”.

3. Attention Mechanisms (für neuronale Netze)

Idee: Das neuronale Netz zeigt selbst, worauf es bei der Entscheidung „schaut”.

Beispiel (Transformer für Zeitreihen):

Model decision: BUY

Attention weights:

- Last 5 candles: 0.02 (ignorieren)

- Candles 10-15: 0.35 (wichtig!)

- Candles 20-30: 0.15

- Volume spike: 0.40 (sehr wichtig!)

Interpretation: Das Modell kaufte wegen eines Volumen-Spikes vor 10 Kerzen + einem Muster vor 10-15 Kerzen.

Funktioniert XAI in der Realität?

Vorteile:

-

Der McKinsey-Bericht 2025 nennt XAI einen „strategic enabler” für die KI-Adoption

-

Banken, die XAI nutzen, zeigten verbessertes Kundenvertrauen

-

Kosten für das Modellrisikomanagement sanken (einfacheres Debugging)

Nachteile:

-

XAI-Erklärungen können irreführend sein (zeigen Korrelation, nicht Kausalität)

-

Komplexe Modelle (tiefe NNs) sind immer noch nicht vollständig erklärbar

-

XAI verlangsamt die Inferenz (Rechenaufwand)

Fazit:

XAI hilft, löst das Problem aber nicht vollständig. Ein komplexes Modell bleibt komplex.

Regulierung: Was die Behörden verlangen

EU AI Act (2025)

Trat am 1. August 2024 in Kraft, mit stufenweiser Einführung der Anforderungen:

Anforderungen für „Hochrisiko-KI” (einschließlich Trading):

- Transparenz: Systeme müssen transparent sein

- Menschliche Aufsicht: Ein Mensch muss eingreifen können

- Genauigkeit: Systeme müssen zuverlässig sein

- Robustheit: Schutz vor adversarialen Angriffen

- Dokumentation: Detaillierte Dokumentation der Logik

Strafen: Bis zu 35 Mio. Euro oder 7 % des weltweiten Umsatzes (je nachdem, was höher ist).

Was das bedeutet:

Wenn Ihr KI-Roboter eine Black Box ist, verstoßen Sie gegen das Gesetz in der EU.

SEC (USA)

Die SEC hat Durchsetzungsmaßnahmen eingeleitet gegen Unternehmen wegen „AI Washing” — falscher Behauptungen über KI-Nutzung.

Beispiele für Verstöße:

- Behaupteten „AI-powered”, nutzten aber einfache If-Then-Regeln

- Versprachen „Deep Learning”, legten aber nicht offen, wie das Modell funktioniert

- Übertrieben die Modellgenauigkeit

Position der SEC:

“AI washing could lead to failures to comply with disclosure requirements and lead to investor harm.”

FCA (Großbritannien) und ESMA (EU)

Sie verlangen:

- Transparente Entscheidungsfindung für automatisierten Handel

- Kill Switch (Möglichkeit, das System sofort zu stoppen)

- Post-Trade-Reporting (Erklärung, warum ein Trade ausgeführt wurde)

Wie Sie sich vor Black-Box-KI-Risiken schützen

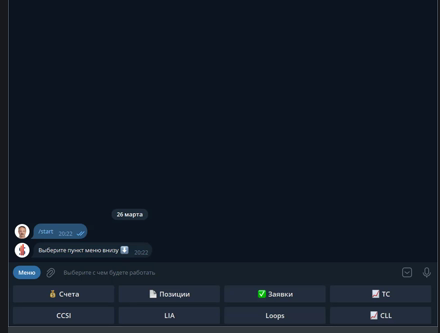

1. Verwenden Sie hybride Systeme

Idee: KI generiert Signale, ein Mensch trifft die finale Entscheidung.

Beispiel:

class HybridTradingSystem:

def __init__(self):

self.ai_model = DeepLearningModel()

self.risk_manager = HumanRiskManager()

def trade(self, market_data):

# KI generiert Signal

ai_signal = self.ai_model.predict(market_data)

confidence = self.ai_model.get_confidence()

# Erklärung

explanation = self.get_explanation(market_data, ai_signal)

# Menschliche Genehmigung bei geringer Konfidenz

if confidence < 0.7:

approved = self.risk_manager.approve(ai_signal, explanation)

if not approved:

return None

return ai_signal

Ergebnis: KI beschleunigt, Mensch kontrolliert.

2. Implementieren Sie XAI vom ersten Tag an

Nicht:

model.predict(X) # Antwort erhalten, Grund unbekannt

Sondern:

prediction, explanation = model.predict_with_explanation(X)

log(f"Decision: {prediction}, Reason: {explanation}")

Protokollieren Sie immer die Erklärungen. Wenn es Verluste gibt, wissen Sie warum.

3. Überwachen Sie regelmäßig den Concept Drift

Code:

from scipy import stats

def detect_drift(recent_predictions, historical_predictions):

# KS-Test zum Vergleich der Verteilungen

statistic, pvalue = stats.ks_2samp(recent_predictions, historical_predictions)

if pvalue < 0.05:

alert("Concept drift detected! Model may be outdated.")

return True

return False

# Jeden Tag

if detect_drift(last_30_days_predictions, training_period_predictions):

retrain_model()

4. Circuit Breakers und Kill Switches

Regeln:

- Maximaler täglicher Drawdown: -5 %

- Maximale Trades pro Stunde: 100

- Maximale Positionsgröße: 10 % des Portfolios

Code:

class CircuitBreaker:

def __init__(self):

self.daily_loss = 0

self.trades_this_hour = 0

def check_before_trade(self, trade):

# Täglichen Verlust prüfen

if self.daily_loss < -0.05:

raise CircuitBreakerTripped("Daily loss limit exceeded")

# Trade-Häufigkeit prüfen

if self.trades_this_hour > 100:

raise CircuitBreakerTripped("Hourly trade limit exceeded")

# Positionsgröße prüfen

if trade.size > self.portfolio_value * 0.10:

raise CircuitBreakerTripped("Position size too large")

5. Backtest auf Worst-Case-Szenarien

Testen Sie nicht nur unter „normalen” Marktbedingungen.

Testen Sie auf:

- COVID-Crash (März 2020)

- Flash Crash (Mai 2010)

- SVB-Kollaps (März 2023)

- FTX-Kollaps (November 2022)

Frage: Würde Ihre KI einen Tag mit -20 % überleben?

6. Beginnen Sie mit wenig Kapital

Nicht:

„Backtest zeigte Sharpe 2,0, ich stecke mein gesamtes Portfolio rein!”

Sondern:

„Backtest zeigte Sharpe 2,0, ich beginne mit 5 % meines Portfolios. In 3 Monaten — erhöhe ich.”

Statistik:

Forschung zeigt: 80 % der Strategien mit gutem Backtest scheitern in den ersten 3 Monaten im Live-Trading.

Fazit

Kann KI beim Trading helfen? Ja.

Kann KI schaden? Ja. Und erheblich.

Wichtigste Erkenntnisse:

- Black-Box-KI ist ein Risiko — 85 % der Trader vertrauen Systemen ohne Erklärungen nicht

- Reale Verluste sind enorm — von 50 Mio. $ (Hedgefonds) bis 1,7 Mrd. $ (CFTC-Fälle)

- Regulierer fordern Transparenz — EU AI Act, SEC, FCA

- XAI hilft, ist aber kein Allheilmittel — komplexe Modelle bleiben komplex

- Der hybride Ansatz ist sicherer — KI generiert, Mensch entscheidet

Praktische Empfehlungen:

- Verwenden Sie XAI (SHAP, LIME) zur Erklärung von Entscheidungen

- Implementieren Sie Circuit Breakers und Kill Switches

- Überwachen Sie Concept Drift regelmäßig

- Beginnen Sie mit wenig Kapital

- Testen Sie auf Worst-Case-Szenarien

- Vertrauen Sie NICHT „KI-Bots” ohne transparente Logik

- Setzen Sie KEINE Black Box auf Ihr gesamtes Portfolio

- Ignorieren Sie NICHT regulatorische Anforderungen

Nächster Artikel:

Experiment: LLM + klassischer Algorithmus — können wir eine Strategie mit KI-Filtern verbessern und dabei die Erklärbarkeit bewahren?

KI ist ein mächtiges Werkzeug. Aber wie jedes mächtige Werkzeug erfordert es Vorsicht, Kontrolle und Verständnis.

Rendite ohne Verständnis ist kein Vorteil. Es ist Roulette.

Nützliche Links:

Black-Box-KI-Risiken:

- Black Box AI: Hidden Algorithms and Risks in 2025

- AI in Finance: How to Trust a Black Box?

- Transparent AI vs Black Box Trading Systems

- Why Blackbox AI Matters to Businesses

Reale Fehlschläge:

- CFTC: AI Won’t Turn Trading Bots into Money Machines

- How AI Crypto Trading Bots Lose Millions

- Lessons from Algo Trading Failures

- Systemic Failures in Algorithmic Trading

Flash Crashes und systemisches Risiko:

Explainable AI:

- 2025 Guide to Explainable AI in Forex Trading

- Understanding Black Box AI: Challenges and Solutions

- Risks and Remedies for Black Box AI

Regulierung:

Diskussion

Diskutieren Sie mit in unserem Telegram-Chat!